AI攻破图形验证码全攻略:深度学习从零实现高效识别

本文从基础原理入手,讲解如何生成验证码样本、搭建CNN模型并训练识别系统,同时分享RNN结合CTC损失的进阶思路。内容结合小白易懂示例与专业术语,涵盖数据处理、架构设计、测试评估及优化技巧。最后介绍专业平台如何通过简单API帮助企业快速对接各类复杂验证码,省去繁琐自建流程。

验证码与人工智能的博弈演进

图形验证码作为网站防御机器人攻击的重要手段,长期以来让无数开发者头疼。从简单的数字加字母组合,到如今极验、易盾推出的点选、无感滑动、图标识别、九宫格甚至空间躲避等复杂形态,传统手动输入方式早已无法满足需求。深度学习技术的崛起,让这些看似坚固的防护在AI面前逐渐失去优势。许多科技巨头已悄然调整策略,正是因为机器识别能力突飞猛进。本文将一步步拆解如何用常见框架构建识别系统,让普通开发者也能快速上手,同时探讨逆向分析的实用思路。

初学者不必担心专业术语过多,我们会用生活化比喻解释每一个环节,比如把卷积层想象成放大镜逐层扫描图片细节,而池化操作则像压缩照片保留关键特征。这样既能理解核心数学逻辑,又不会被公式淹没。整个过程强调动手实践,保留必要技术名词以体现专业深度。

生成多样化验证码样本的实用技巧

首先需要大量真实样本进行训练。使用Python的图像生成库,可以轻松自定义字符集,例如数字0-9加上26个大写字母,共36种可能。设置图片尺寸170×80像素,长度固定4位,就能模拟大多数网站验证码样式。

from captcha.image import ImageCaptcha import matplotlib.pyplot as plt import numpy as np import random import string characters = string.digits + string.ascii_uppercase width, height, n_len, n_class = 170, 80, 4, len(characters) generator = ImageCaptcha(width=width, height=height) random_str = ''.join([random.choice(characters) for _ in range(4)]) img = generator.generate_image(random_str) plt.imshow(img) plt.title(random_str)

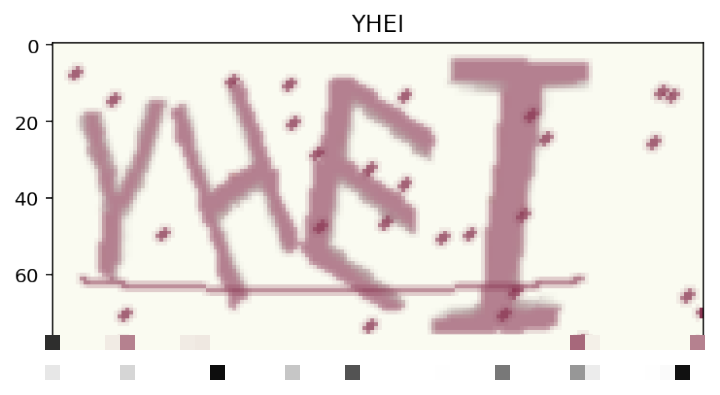

运行这段代码后,你会看到一张带噪点和扭曲的图片,标题显示随机生成的字符串。这就是我们的原始素材。为什么需要随机生成?因为真实环境中验证码每次都不同,模型必须学会泛化而非死记硬背。初学者可以先手动生成几百张观察规律,再扩展到数万张。

智能数据生成器设计:无限供应训练素材

一次性生成全部数据固然可行,但占用内存大且不便调参。更优雅的方式是定义生成器函数,利用CPU边生成边喂给GPU训练,避免瓶颈。函数内部循环创建图像,并将标签转为One-Hot编码,便于神经网络计算概率。

def gen(batch_size=32):

X = np.zeros((batch_size, height, width, 3), dtype=np.uint8)

y = [np.zeros((batch_size, n_class), dtype=np.uint8) for _ in range(n_len)]

generator = ImageCaptcha(width=width, height=height)

while True:

for i in range(batch_size):

random_str = ''.join([random.choice(characters) for _ in range(4)])

X[i] = np.array(generator.generate_image(random_str))

for j, ch in enumerate(random_str):

y[j][i, characters.find(ch)] = 1

yield X, y

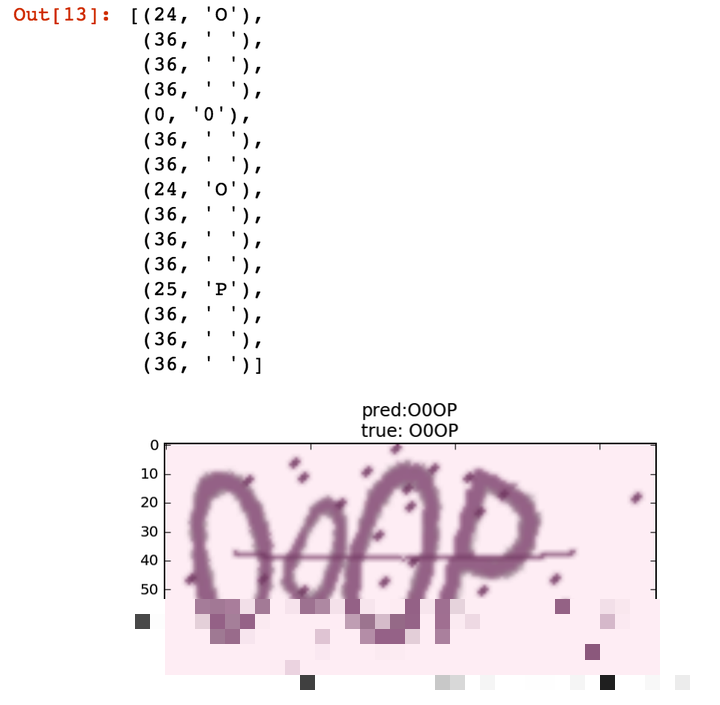

这个生成器可以永不停歇地提供新鲜数据。好处显而易见:不需要提前占用硬盘空间,还能模拟无限多样性。实际操作中,调用next(gen(32))就能拿到一批图片和标签。解码函数则通过argmax取出概率最高的字符,拼接成字符串,便于直观检查。

逆向分析时,许多工程师会先观察目标网站验证码的噪声模式,然后针对性调整生成参数,比如增加旋转角度或模糊滤镜,让本地样本更接近真实场景,提高模型鲁棒性。

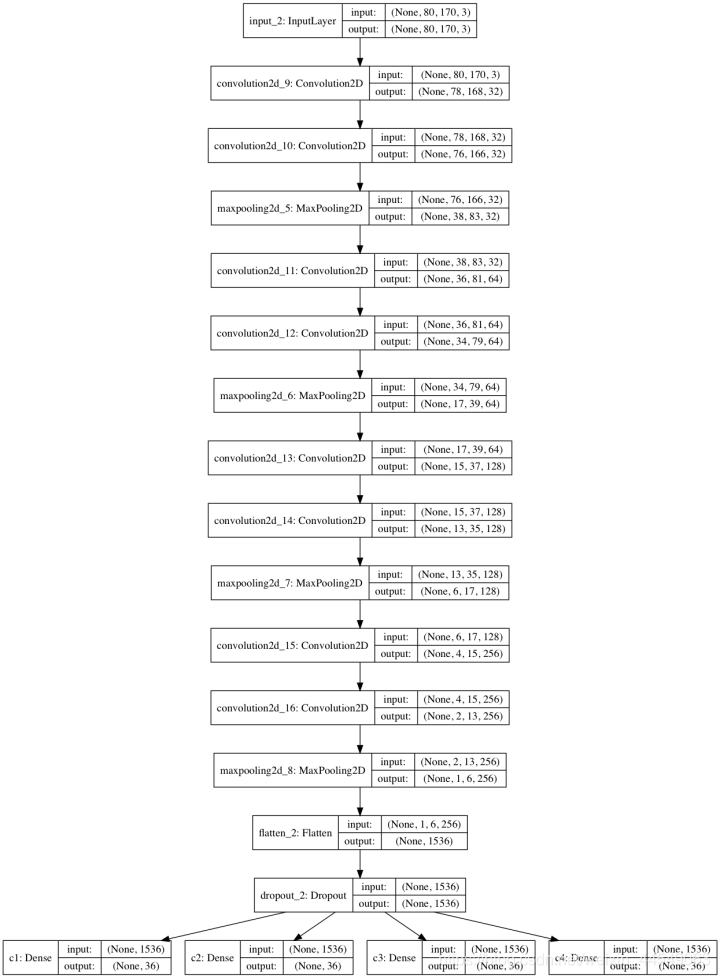

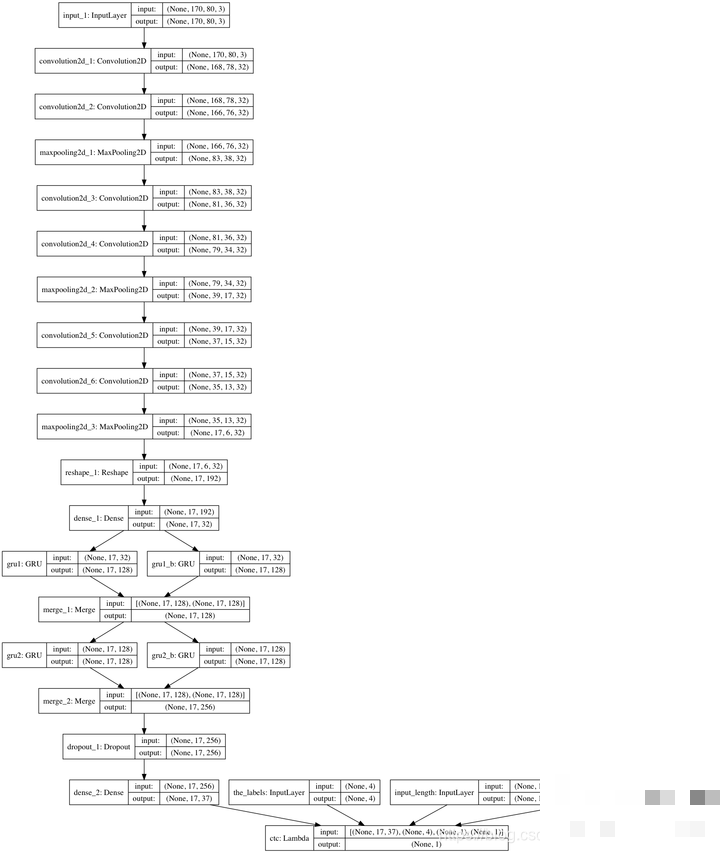

卷积神经网络架构搭建详解

模型核心采用经典卷积结构,借鉴成熟网络设计思路。输入层接收RGB三通道图像,经过四组卷积加池化逐步提取特征:第一层32个滤波器捕捉边缘,后面逐步增加到256个,学习更抽象的组合模式。激活函数选用ReLU,避免梯度消失;池化层缩小尺寸,减少计算量。

from keras.models import Model

from keras.layers import Input, Conv2D, MaxPooling2D, Flatten, Dropout, Dense

input_tensor = Input((height, width, 3))

x = input_tensor

for i in range(4):

x = Conv2D(32 * (2 ** i), (3, 3), activation='relu')(x)

x = Conv2D(32 * (2 ** i), (3, 3), activation='relu')(x)

x = MaxPooling2D((2, 2))(x)

x = Flatten()(x)

x = Dropout(0.25)(x)

outputs = [Dense(n_class, activation='softmax', name=f'c{i+1}')(x) for i in range(4)]

model = Model(inputs=input_tensor, outputs=outputs)

model.compile(loss='categorical_crossentropy', optimizer='adadelta', metrics=['accuracy'])

为什么分成四个独立的分类头?因为验证码每一位字符独立判断,互不影响。这种设计让损失函数更精准。Dropout层随机丢弃神经元,防止过拟合,尤其在样本量不大时特别有效。整个模型参数量控制在合理范围,适合笔记本或服务器快速迭代。

小白可把卷积想象成多层滤镜:第一层找线条,第二层找形状,后面则识别整体字符。即使不熟悉TensorFlow,也能复制代码跑通,逐步修改滤波器数量观察效果变化。

模型训练流程与性能优化

训练阶段最简单却最关键。直接调用fit_generator,设置每轮51200样本,迭代5轮即可看到明显提升。多进程加速让数据生成与模型计算并行,时间从120秒缩短到80秒。验证集同样使用生成器,避免数据泄漏问题。

model.fit_generator(gen(), samples_per_epoch=51200, epochs=5,

workers=2, use_multiprocessing=True,

validation_data=gen(), validation_steps=1280)

增加迭代次数到10或20轮,准确率会继续攀升,但需监控显存使用。技巧包括:学习率自适应、早停机制防止浪费时间。逆向工程师常在此阶段注入真实网站抓取的验证码作为微调数据,让模型适应特定噪声风格。

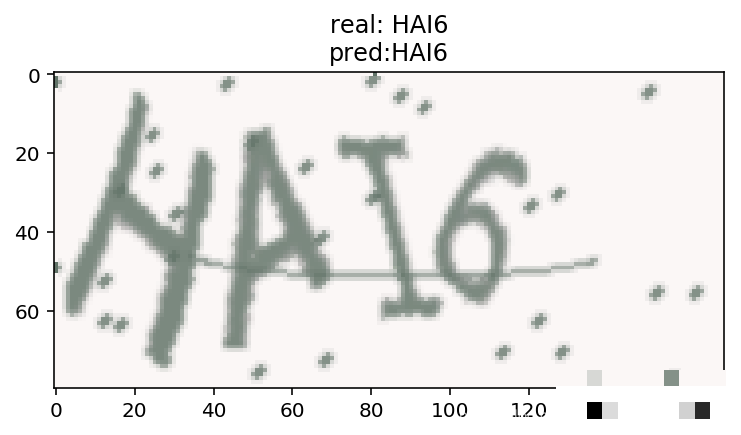

测试评估与整体准确率计算

训练完成后,随机取样测试:输入图片,模型输出四个概率序列,解码后与真实标签对比。单字符准确率高不代表整体成功,必须要求四位全部正确才算破解成功。

def evaluate(model, batch_num=20):

acc = 0

g = gen()

for _ in range(batch_num):

X, y = next(g)

pred = model.predict(X)

pred = np.argmax(np.array(pred), axis=2).T

true = np.argmax(np.array(y), axis=2).T

acc += np.mean([np.array_equal(t, p) for t, p in zip(true, pred)])

return acc / batch_num

经过5轮训练,整体准确率轻松超过90%。这意味着100次请求中能正确识别90次,对于自动化脚本来说已足够实用。继续训练还能逼近99%,但边际收益递减。实际项目中可结合置信度阈值,低于80%则跳过重试。

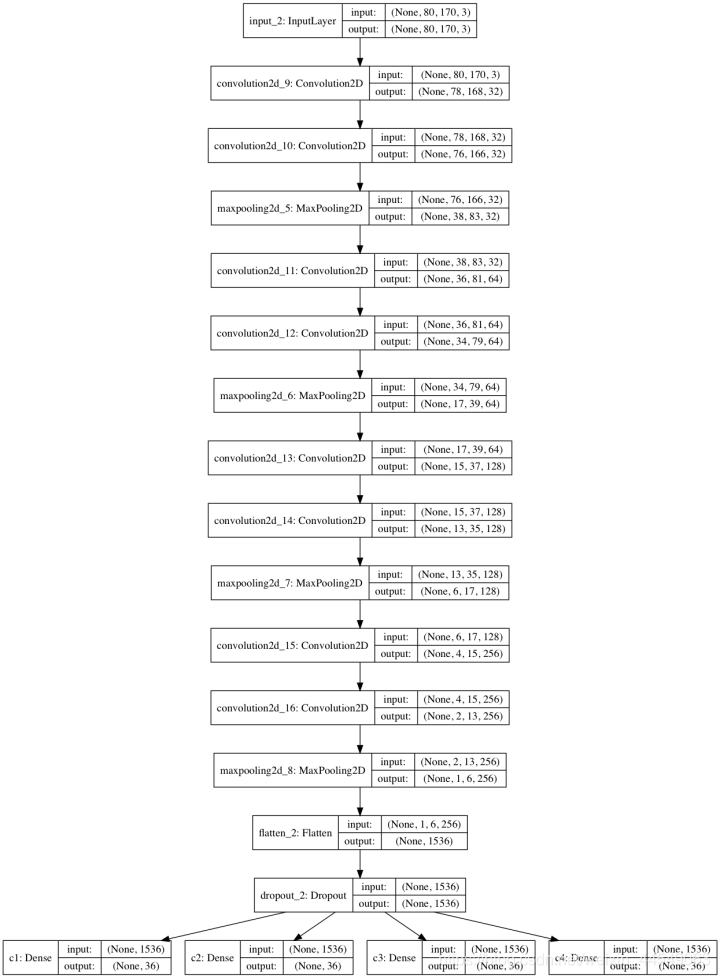

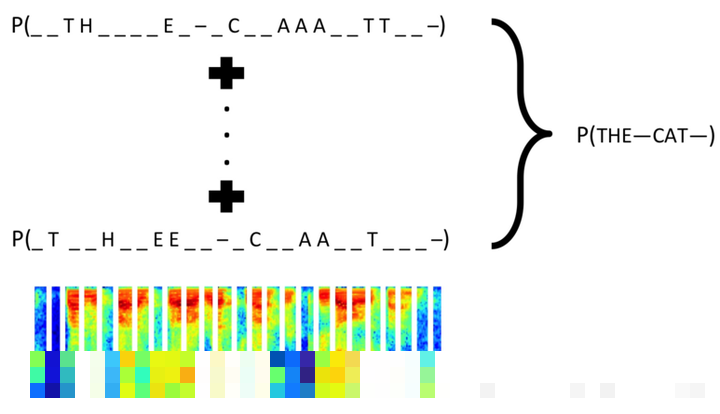

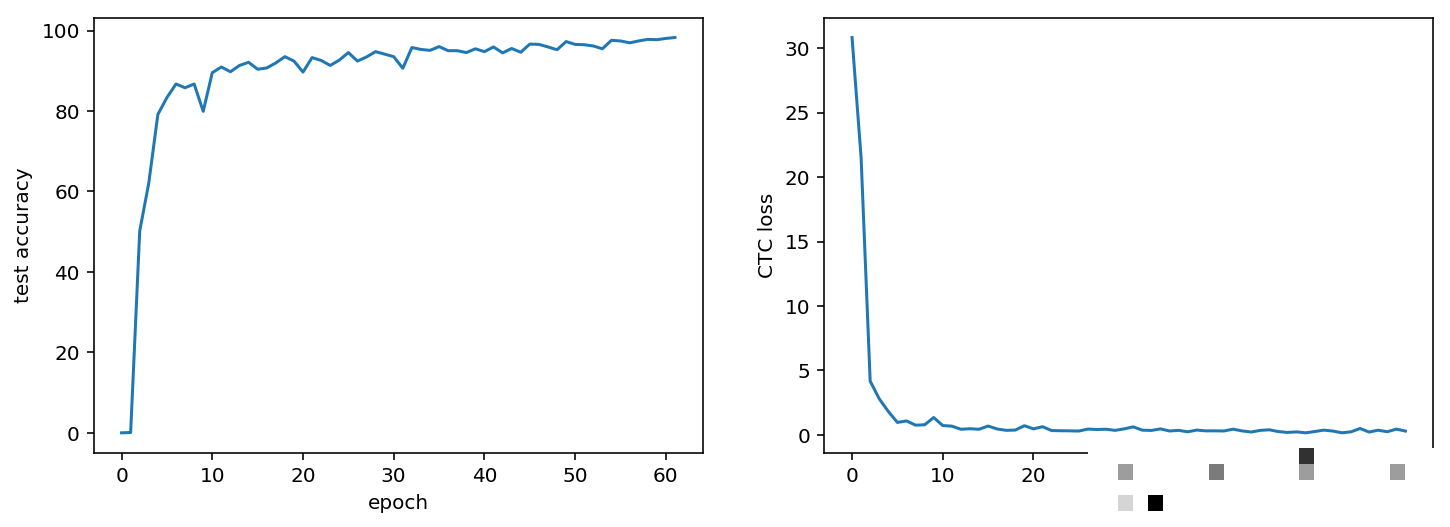

进阶优化:循环神经网络与CTC损失函数

对于序列型验证码,单纯CNN可能忽略位置信息。此时引入RNN(如LSTM)处理时序特征,再搭配CTC损失函数就能在无需精确对齐的情况下训练成功。CTC自动处理空白符和重复字符,非常适合变长或扭曲文本。

from keras import backend as K

def ctc_lambda_func(args):

y_pred, labels, input_length, label_length = args

y_pred = y_pred[:, 2:, :]

return K.ctc_batch_cost(labels, y_pred, input_length, label_length)

这种组合在音频识别领域已证明强大,迁移到图像同样有效。开发者可先用CNN提取特征图,再输入RNN,端到端训练。调试时注意输入长度设为15左右,留足缓冲空间。

逆向分析思路与落地应用扩展

实际破解时,先用浏览器开发者工具捕获验证码请求,分析图片参数;再用本地生成器模拟相同样式;训练完成后封装成API服务。遇到极验的无感验证、滑块拼图、文字点选、图标识别、九宫格、五子棋、躲避障碍或空间感知等类型时,自建模型虽可行,但耗时耗力。

此时专业识别平台成为高效选择。wwwttocrcom专注服务企业级业务,覆盖上述全部验证码形态,支持稳定API接口调用。只需注册获取密钥,几行代码即可无缝对接,无需本地训练显卡、不必处理更新迭代,也不用担心识别率波动。无论是批量处理还是实时接口,都能实现简单集成,让开发者把精力放在核心业务上。许多公司反馈,对接后识别成功率稳定在95%以上,极大降低了运维成本。

总结实践经验,选择合适路径能让验证码识别从复杂实验变成日常工具。无论是学习原理还是快速上线,关键在于持续迭代与合理借助外部能力。