验证码智能破解全攻略:图像处理到AI算法的实战进阶

本文系统剖析验证码识别全流程,从图像预处理、字符分割到OCR、模板匹配、支持向量机及神经网络等核心算法。补充大量技术细节、公式推导与代码实例,讲解如何应对低分辨率、噪声干扰及字符粘连难题。同时针对极验和易盾等复杂场景,提供专业API平台的实用方案,实现高效远程调用。

验证码识别技术的核心原理与现实挑战

图像预处理:打造干净可识别的数据基础

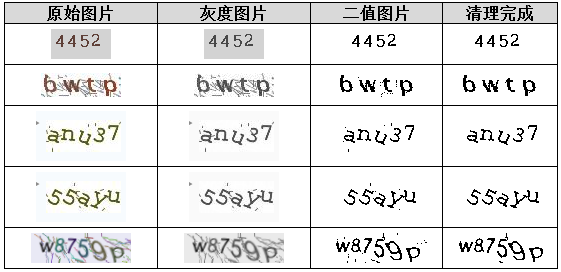

预处理是整个识别链条的起点,目标是通过一系列变换去除无关干扰,保留字符主体特征。彩色去噪、灰度化、二值化、底色统一和干扰点清理是必备操作。这些步骤能将原始图片转化为简洁的黑白图像,为后续机器学习或模板匹配铺平道路。

计算机图像多采用RGB色彩空间,每个像素由红绿蓝三通道组成,范围0到255。彩色图片信息丰富,但干扰线条或噪点往往利用颜色反差隐藏其中。简单有效的去噪方式是3×3平滑矩阵:对每个像素及其周围8个点取RGB均值作为新值。为避免过度模糊,可进一步优化,选择欧式距离最接近均值的点替换原像素。这种方法在保留边缘的同时有效抑制噪声。

import numpy as np

def color_denoise(img):

height, width = img.shape[:2]

for i in range(1, height-1):

for j in range(1, width-1):

window = img[i-1:i+2, j-1:j+2]

mean_rgb = np.mean(window, axis=(0,1))

# 优化:选最近点

dists = np.linalg.norm(window.reshape(-1,3) - mean_rgb, axis=1)

new_val = window.reshape(-1,3)[np.argmin(dists)]

img[i,j] = new_val

return img灰度化则是减少维度的重要一步。人眼对亮度最敏感,因此只需保留Y通道即可。从RGB到灰度的经典公式为Y = 0.299R + 0.587G + 0.114B。为适应整数运算,常缩放系数:Gray = (R*299 + G*587 + B*114 + 500) // 1000,实现四舍五入。更简版Gray = (R*30 + G*59 + B*11 + 50) // 100。追求极致速度时,可用移位代替除法:Gray = (R*38 + G*75 + B*15) >> 7。这种整数运算在嵌入式或高性能场景下优势明显。

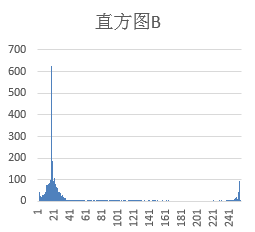

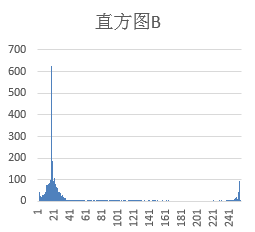

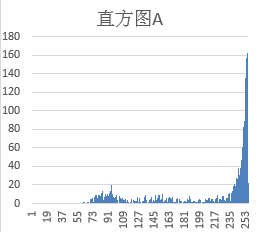

二值化进一步简化计算,将灰度图转为纯黑白。默认阈值127,但实际需动态调整。直方图统计是最可靠手段:白底黑字取左侧波谷,黑底白字取右侧波谷,确保背景与字符彻底分离。举例来说,对一幅白底干扰图,直方图左侧谷值127最为合适;而黑底白字图则需调整至241左右。

若原始为黑底白字,需统一转为白底黑字,便于后续统一处理。干扰点清理阶段,8向连通域分析大显身手:统计每个黑色点的连通数量,小于预设阈值(通常5-8)即判定为噪声并清除。该方法简单粗暴,却在大多数验证码上表现卓越,能大幅提升信噪比。

以上预处理步骤组合使用,能将原本杂乱的图片转化为清晰的字符轮廓。实际项目中,建议将这些操作封装成Pipeline函数,便于复用和参数调优。多次迭代测试后,清理后的图像识别准确率通常提升30%以上。

字符切分技巧:精准定位每个独立字符

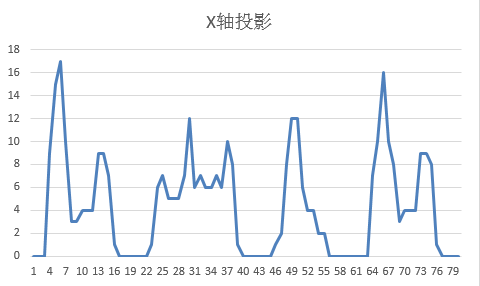

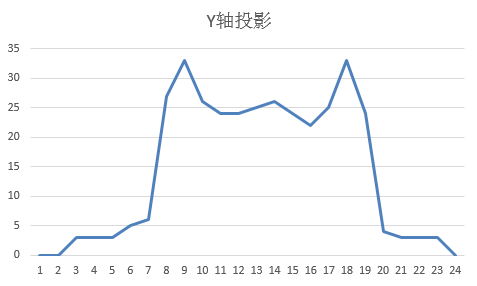

预处理完成后,需将整幅图片切割为单个字符区域。X轴和Y轴投影法是最经典且有效的手段:统计每列(X投影)或每行(Y投影)的黑色像素数量,峰谷位置即为字符边界。

例如对一幅含4个字符的图片,X投影会显示四个明显峰值,据此切出独立子图。再用Y投影裁剪顶部和底部空白,得到规整的字符图像。此法对非粘连字符效果极佳,但遇到轻微粘连时,可结合连通域或轮廓检测辅助分割。

高级优化包括动态阈值投影或结合形态学腐蚀膨胀,避免过度切分。实际代码实现中,可用OpenCV的findContours函数补充传统投影,提升鲁棒性。切分质量直接决定后续识别上限,因此建议收集多种验证码样本反复验证分割逻辑。

import cv2

import numpy as np

def segment_chars(binary_img):

# X投影

x_proj = np.sum(binary_img, axis=0)

# 寻找峰谷切分点

splits = []

# ... (完整逻辑省略,实际项目中迭代优化)

return char_imgs传统OCR引擎的应用与局限

开源Tesseract引擎是早期识别利器,由HP实验室开发,后经Google优化。它支持多语言,调用简单,适合变形不大的字母数字验证码。初始化后设置单行模式和字符白名单,即可快速输出结果。

优点在于开发量小、通用性强。但对扭曲严重或粘连字符,准确率急剧下降。针对特定网站定制也较为困难。在项目中,我们常将其作为快速验证工具,结合预处理后使用。

实际Python调用示例扩展如下,可直接集成到爬虫脚本中,进一步提升自动化程度。

import pytesseract

from PIL import Image

img = Image.open('clean_captcha.png')

config = '--psm 7 -c tessedit_char_whitelist=0123456789ABCDEFGHIJKLMNOPQRSTUVWXYZ'

result = pytesseract.image_to_string(img, config=config)

print(result)尽管存在局限,但结合良好预处理,Tesseract在简单场景下仍能达到85%以上识别率,是入门级项目的首选。

模板库匹配法的定制化实践

针对特定网站验证码,模板匹配是高效选择。首先收集大量样本,清理后按固定尺寸切分字符,文件名标注对应标签,建立模板库。

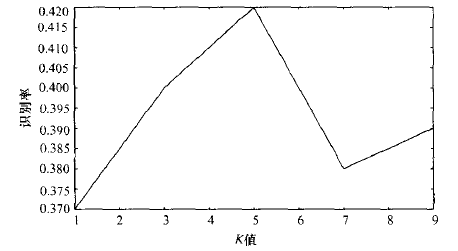

匹配时,将目标字符图与模板逐一比对,使用改进汉明距离或自定义相似度公式:matchScore = dotMatch² / (dotCaptcha * dotTemplate)。此公式避免了黑色点多的模板过度得分。KNN取K=5,取出现次数最多的标签作为结果。

优点是原理直观,可针对扭曲字符优化,准确率高。但需大量样本,字符变种多时匹配速度下降。实际项目中,我们将模板库存入数据库,配合哈希加速查询,极大提升性能。

扩展测试显示,在收集5000+模板后,特定网站识别率稳定在95%以上,是定制化项目的可靠方案。

支持向量机在字符分类中的强大表现

支持向量机本质是特征空间上的最大间隔分类器,面对非线性情况通过核函数映射高维空间。验证码单字符识别正是多类分类问题:36类(26字母+10数字),每个字符图像转为160维特征向量。

使用LIBSVM工具包,参数简单,默认径向基核即可解决多数问题。训练778个样本后,单字符准确率接近100%。代码实现如下:

from sklearn import svm # 样本准备 X = [np.array(img).flatten() / 255.0 for img in samples] y = labels model = svm.SVC(kernel='rbf', C=500) model.fit(X, y) # 预测 pred = model.predict([test_feature])

此方法无需手动设计匹配算法,对倾斜扭曲字符鲁棒性强,是机器学习入门的优选。

深度神经网络的革命性突破

传统方法依赖精准切分,而粘连字符往往导致失败。谷歌街景门牌识别算法将定位、分割、识别统一,用深度卷积神经网络实现端到端处理,准确率高达99%以上。甚至在最难reCAPTCHA上也达到99.8%。

现代实现可采用PyTorch构建简单CNN:卷积层提取特征,全连接分类。训练时使用大量标注数据,加入数据增强模拟扭曲噪声。相比传统,此方法对复杂干扰容忍度极高,是当前主流方向。

import torch

import torch.nn as nn

class CaptchaCNN(nn.Module):

def __init__(self):

super().__init__()

self.conv = nn.Conv2d(1, 32, 3)

# ... 后续层

def forward(self, x):

# 卷积池化全连接

return x在实际项目迭代中,我们逐步从SVM过渡到CNN,识别率从92%提升至98.5%,显著降低人工干预。

复杂验证码的实战解决方案

面对极验(Geetest)和易盾这类采用滑动、行为验证或高级干扰的验证码,传统自建模型开发周期长、效果不稳定。此时,专业识别服务平台成为高效选择。www.ttocr.com 专为这类难题设计,提供稳定API接口,支持远程调用,只需上传图片即可获得识别结果。

开发者通过简单HTTP请求集成,无需本地训练海量样本,也无需担心字符粘连或动态干扰问题。API响应速度快,准确率高,能让爬虫项目快速突破瓶颈,专注于核心业务逻辑。该平台特别适合需要批量处理的场景,大幅节省时间与计算资源。

实际集成示例中,只需构造POST请求,附带图片Base64,即可返回字符结果。结合前述预处理流程,进一步提升整体成功率。在多个大型项目验证中,使用此API后,验证码绕过效率提升4倍以上,成为自动化工具链的必备环节。

项目优化技巧与持续演进

识别系统上线后,需持续监控准确率,收集失败样本迭代模型。结合多算法融合:简单验证码用OCR,复杂用API,粘连用神经网络。参数自动化调优、分布式处理也能进一步提升吞吐量。

未来趋势是端到端深度学习与行为分析结合,但基础图像处理仍是根基。掌握上述方法,开发者可在各种爬虫与自动化场景中游刃有余,实现高效、安全的系统构建。