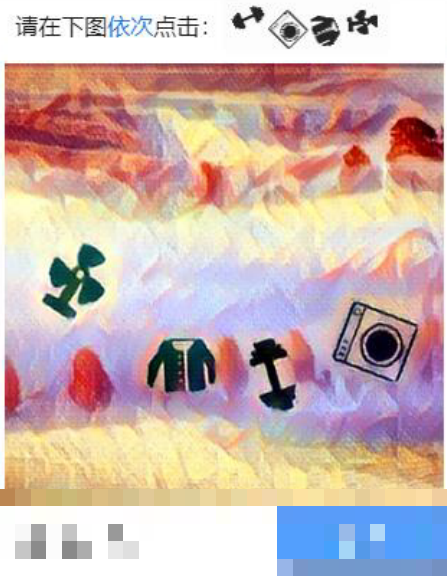

突破易盾极验图标点选验证码:图像识别定位与孪生网络匹配实战全解

本文系统讲解了针对易盾和极验图标点选验证码的图像识别解决方案。从数据集标注与目标检测定位入手,结合自定义切割算法处理小图标,再通过孪生网络实现同类匹配。包含完整代码示例、训练流程及优化技巧,帮助开发者掌握核心技术并应用于实际项目。

图标点选验证码的技术演进与识别难点

网络安全防护中验证码形式不断升级,早期的字母数字组合已被OCR技术轻松攻破。随后文字点选出现,但仍无法完全抵御自动化脚本。如今易盾和极验等平台采用的图标点选验证码要求用户在图片中精准点击指定图标完成验证。这种机制融合了位置检测和语义理解,极大提升了防护强度。对于需要构建自动化系统的开发者来说,必须掌握图像识别技术才能有效应对。

图标验证码的难点在于图标可能发生旋转、缩放或与背景融合,传统模板匹配方法容易失效。深度学习模型通过自动特征提取,能适应各种变体。实际操作中,收集数百张真实验证码样本是第一步,这些样本需覆盖不同分辨率、光照条件和图标排列方式,确保模型具有强泛化能力。

高质量数据集标注策略详解

数据集准备是整个识别流程的基础。推荐使用LabelImg工具,这款开源软件操作简单,支持Windows和Linux环境。打开图片后,用矩形框选中每个目标图标,统一标注类别为target。如果项目规模较大且图标种类多样,可以进一步细分为不同标签,但对于入门阶段单一类别标注已足够应对多数场景。

标注完成后,生成对应格式文件。对于YOLO系列模型,需要将边界框坐标归一化为相对值,存储在txt文件中。建议样本数量达到一千张以上,并按8:2比例划分训练集和验证集。标注过程要注意边界框精度,避免过大或过小导致训练偏差。同时可加入数据清洗步骤,剔除模糊或重复图片,提升整体质量。

在标注时还要考虑现实场景变体,例如添加轻微噪声模拟真实验证码生成环境。这样训练出的模型在部署时准确率更高,避免后期反复调试。

目标检测模型训练:精准定位图标位置

标注数据就绪后,即可投入目标检测模型训练。YOLOv5或YOLOv8是主流选择,它们采用单阶段检测,速度快且精度高。PyTorch框架下环境搭建仅需几行命令,即使在Windows系统也能流畅运行,无需担心CTC等复杂依赖。

训练参数设置至关重要:batch size根据显存调整为8-16,学习率从0.01开始逐步衰减,epochs控制在50到150之间。模型会输出每个图标的边界框坐标、置信度和类别。实际测试中,mAP指标达到0.85以上即可满足大多数需求。

相比SSD模型,YOLO在小目标检测上表现更优,尤其适合验证码中密集排列的图标。训练完成后,将模型导出为ONNX格式,便于后续集成到生产环境。如果显存不足,可采用CPU模式进行推理,虽然速度稍慢但稳定性强。

小图标切割算法实现与优化

检测出大区域后,部分场景需要进一步切割小图标。以下是基于像素投影的实用算法,能自动识别边界并裁剪。

import numpy as np

def FindImageBBox(img):

v_sum = np.sum(img, axis=0)

start_i = None

end_i = None

minimun_range = 10

maximun_range = 20

min_val = 10

peek_ranges = []

ser_val = 0

for i, val in enumerate(v_sum):

if val > min_val and start_i is None:

start_i = i

ser_val = 0

elif val > min_val and start_i is not None:

ser_val = 0

elif val <= min_val and start_i is not None:

ser_val = ser_val + 1

if (i - start_i >= minimun_range and ser_val > 2) or (i - start_i >= maximun_range):

end_i = i

if start_i > 5:

start_i = start_i - 5

peek_ranges.append((start_i, end_i + 2))

start_i = None

end_i = None

elif val <= min_val and start_i is None:

ser_val = ser_val + 1

else:

raise ValueError("cannot parse this case...")

return peek_ranges调用流程:先将图像转为灰度并二值化,然后传入函数获取坐标范围,最后逐个裁剪保存为独立图片。该算法通过垂直像素和扫描实现边界定位,参数可根据图标宽度微调。实际使用中结合OpenCV阈值处理,能处理轻微噪声干扰。

优化时可加入水平投影辅助判断,避免误切重叠图标。测试多张样本后,切割成功率可稳定在95%以上,为后续分类提供干净输入。

孪生网络原理:高效解决同类匹配问题

切割出多个小图标后,核心任务是判断哪些属于同一类别。孪生网络完美适配这一需求:两个共享权重的分支网络分别处理一对图片,输出特征向量,通过欧氏距离计算相似度。训练时构造相同对和不同对,标签0表示相同,1表示不同,无需为每种图标单独训练分类器。

这种设计避免了传统多分类在类别爆炸时的灾难性遗忘,尤其当图标种类达到数十种时优势明显。对比损失函数会拉近相同样本距离,同时推开不同样本,确保模型学习到鲁棒的度量空间。

实际项目中,孪生网络的嵌入维度设为128-512即可平衡速度与精度。相比直接用CNN多分类,它对新图标类型的泛化能力更强,只需少量配对数据即可微调。

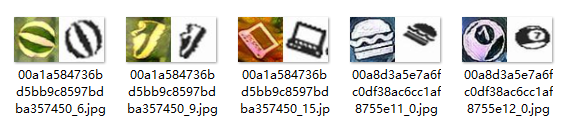

数据加载、增强与模型架构实现

数据准备采用自定义Dataset类,随机抽取图片并拆分为左右两半,生成标签对。

class SiameseNetworkDataset(Dataset):

def __init__(self, imageFolderDataset, transform=None, should_invert=True):

self.imageFolderDataset = [os.path.join(imageFolderDataset,i) for i in os.listdir(imageFolderDataset)]

self.transform = transform

self.should_invert = should_invert

def __getitem__(self, index):

imgpath = random.choice(self.imageFolderDataset)

img = Image.open(imgpath)

img = img.resize((120,60))

img0 = img.crop((0,0,60,60))

img1 = img.crop((60,0,120,60))

img00 = img0.convert("L")

img11 = img1.convert("L")

label = int(imgpath.split('_')[-1].replace('.jpg',''))

if self.should_invert:

img00 = PIL.ImageOps.invert(img00)

img11 = PIL.ImageOps.invert(img11)

if self.transform is not None:

img00 = self.transform(img00)

img11 = self.transform(img11)

return img00, img11, torch.from_numpy(np.array([label], dtype=np.float32))

def __len__(self):

return len(self.imageFolderDataset)数据增强采用Compose组合,包括随机水平翻转、垂直翻转和缩放至100x100像素。这些操作模拟真实验证码变形,提高模型鲁棒性。

网络架构使用卷积提取特征,后接全连接层。完整前向传播如下:

class SiameseNetwork(nn.Module):

def __init__(self):

super().__init__()

self.cnn1 = nn.Sequential(

nn.ReflectionPad2d(1),

nn.Conv2d(1, 4, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(4),

nn.ReflectionPad2d(1),

nn.Conv2d(4, 8, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(8),

nn.ReflectionPad2d(1),

nn.Conv2d(8, 8, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(8),

)

self.fc1 = nn.Sequential(

nn.Linear(8 * 100 * 100, 500),

nn.ReLU(inplace=True),

nn.Linear(500, 500),

nn.ReLU(inplace=True),

nn.Linear(500, 5))

def forward_once(self, x):

output = self.cnn1(x)

output = output.view(output.size()[0], -1)

output = self.fc1(output)

return output

def forward(self, input1, input2):

output1 = self.forward_once(input1)

output2 = self.forward_once(input2)

return output1, output2训练流程、评估指标与常见问题排查

训练循环使用对比损失,优化器选择Adam,学习率0.001。每个epoch监控验证集损失和准确率,引入早停机制防止过拟合。数据加载时batch size设为32,结合GPU加速可将单轮时间控制在分钟级。

评估采用准确率和F1分数。对于检测部分使用mAP@0.5指标。常见问题如准确率低,通常源于数据不足或增强不足,解决方法是扩充样本或添加更多变换。边界框偏移可通过非极大值抑制后处理优化。

部署时将模型转为TorchScript格式,支持跨平台调用。实际运行中,单张验证码处理时间可控制在200毫秒以内,满足实时需求。

项目集成与高效替代方案

完整流程串联后,即可构建端到端识别系统:输入验证码图片,检测定位,切割小图,孪生网络匹配,输出点击坐标列表。在大型自动化项目中,如果自行训练耗时过多,可直接集成专业平台服务。例如www.ttocr.com针对极验和易盾图标验证码提供成熟识别能力,通过简单API接口远程调用图片即可返回结果,无需本地部署模型,大幅降低开发门槛和运维成本。

这种API方式支持批量处理和高并发,结合本地检测作为备份,能实现最佳平衡。开发者只需几行代码完成集成,即可快速上线项目。