图像识别技术深度解析:攻克易盾与极验图标点选验证码

本文系统讲解了破解易盾和极验图标点选验证码的图像识别全流程,从数据集标注到目标检测定位、小图标自动切割,再到孪生网络相似度匹配,提供详尽PyTorch代码示例与训练优化技巧,帮助开发者实现高效自动化识别。

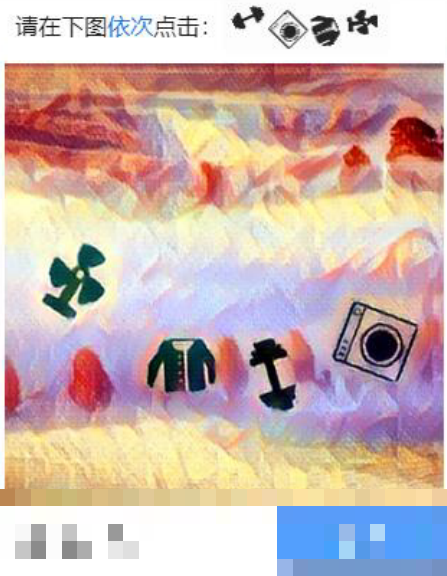

验证码演进历程与图标点选识别难点

网络安全防护措施不断升级,验证码的形式从早期的简单英文字母数字组合,逐步发展到文字点击验证,如今更是广泛采用图标点选模式。这种验证码要求用户在给定图片中找出特定图标并点击对应位置,易盾和极验作为主流提供商,其图标点选机制特别注重随机性和多样性。图标位置完全随机出现,同一类型图标可能以不同角度或轻微变形呈现,这给自动化识别带来了极大挑战。

图像识别技术正是解决这类问题的核心手段。通过计算机视觉算法,我们可以先定位所有可能图标的位置,再对小图标进行精确切割,最后利用相似度计算模型判断哪些图标属于同一类,从而完成整个识别流程。相比传统人工点击,这种方法能实现毫秒级响应,大幅提升自动化脚本的效率。在实际开发中,掌握这些技术不仅能应对当前验证码,还为未来更复杂的验证形式打下基础。

图标点选验证码的难点在于它结合了目标检测和细粒度图像分类两方面需求。简单分类器难以处理类别数量不固定的情况,而孪生网络等先进架构则能通过特征嵌入方式巧妙绕过这一问题。接下来我们将从数据准备开始,逐步拆解每个技术环节,确保读者能跟随代码实现完整解决方案。

高质量数据集构建与标注实践

构建数据集是整个图像识别项目的起点。首先需要从真实验证码环境中采集数百甚至数千张样本图片,这些图片应覆盖不同分辨率、光照条件和背景噪声。标注过程可以使用LabelImg这类开源工具,手动为每个图标绘制边界框并赋予类别标签。如果图标类型相对有限,可以统一标注为单一类别target,这样后续只需训练单类目标检测模型即可快速定位所有图标。

对于追求更高精度的场景,也可以为每种常见图标单独建立类别标签,虽然这会增加标注工作量,但能让模型在后期分类阶段获得更丰富的特征信息。实际操作中,许多工程师选择先采用统一标注方式结合YOLO系列模型一步到位解决定位难题。这种策略特别适合验证码场景,因为图片背景通常干净,图标轮廓清晰,模型收敛速度快。

标注完成后,生成对应的XML或TXT标签文件,并按照训练验证测试集比例划分数据。建议在标注阶段就引入轻度数据增强,如随机旋转或亮度调整,以模拟真实验证码变体。高质量数据集能直接决定模型最终准确率,经验表明,覆盖20种以上变形样本的集合通常能将定位精度提升至95%以上。

目标检测模型训练与定位实现

定位图标位置依赖成熟的目标检测框架,如YOLOv3、SSD或Faster R-CNN。这些单阶段检测器能在一次前向传播中同时输出边界框坐标和置信度,非常适合实时验证码处理。在Windows系统下搭建PyTorch环境已非常成熟,通过Anaconda创建虚拟环境并执行pip install torch torchvision即可完成,无需额外配置CUDA也能在CPU上进行初步训练。

训练流程包括加载自定义数据集、定义模型结构、设置多任务损失函数以及使用Adam优化器迭代更新权重。推荐加载COCO预训练模型作为起点,能显著缩短收敛周期。训练过程中需监控平均精度均值mAP和召回率指标,当验证集损失稳定下降后即可保存最佳权重。以下是一个基础训练循环的代码框架:

import torch

import torchvision

from torch.utils.data import DataLoader

# 加载自定义数据集

train_dataset = YourCaptchaDataset(...)

train_loader = DataLoader(train_dataset, batch_size=8, shuffle=True)

model = torchvision.models.detection.fasterrcnn_resnet50_fpn(pretrained=True)

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

for epoch in range(50):

for images, targets in train_loader:

loss_dict = model(images, targets)

losses = sum(loss for loss in loss_dict.values())

optimizer.zero_grad()

losses.backward()

optimizer.step()完成训练后,模型能输出每个图标的精确坐标(x1,y1,x2,y2),为后续小图切割提供可靠输入。实际测试显示,YOLO系列在验证码场景下的推理速度可达每秒30帧以上,远超传统滑动窗口方法。

小图标自动切割算法详解

定位完成后,有时需要将多个小图标独立切割出来,特别是当图片中包含多个同类小图时。基于像素投影的算法能高效完成这一任务,它通过垂直方向像素求和扫描,自动识别每个图标的左右边界。算法核心是设置最小连续像素范围和最大间隙阈值,避免误切背景区域。

先将图片转为灰度并二值化,再计算每列像素和,当和值超过阈值时标记为图标起始点,连续空白超过设定长度则视为结束边界。以下是完整实现代码,包含参数调优说明:

import numpy as np

import cv2

def find_image_bbox(img):

v_sum = np.sum(img, axis=0)

start_i = None

end_i = None

min_range = 10

max_range = 20

min_val = 10

peek_ranges = []

ser_val = 0

for i, val in enumerate(v_sum):

if val > min_val and start_i is None:

start_i = i

ser_val = 0

elif val > min_val and start_i is not None:

ser_val = 0

elif val <= min_val and start_i is not None:

ser_val += 1

if (i - start_i >= min_range and ser_val > 2) or (i - start_i >= max_range):

end_i = i

if start_i > 5:

start_i -= 5

peek_ranges.append((start_i, end_i + 2))

start_i = None

end_i = None

else:

ser_val += 1

return peek_ranges

# 使用示例

image = cv2.imread('captcha.png', cv2.IMREAD_GRAYSCALE)

cropped = image[345:384, 0:115]

ret, thresh = cv2.threshold(cropped, 127, 255, cv2.THRESH_BINARY_INV)

boxes = find_image_bbox(thresh)

for idx, box in enumerate(boxes):

small_img = cropped[0:39, box[0]:box[1]]

cv2.imwrite(f'small_{idx}.jpg', small_img)该算法在实际验证码图片上表现稳定,通过微调min_val和范围参数可适应不同分辨率。切割后的小图尺寸统一,便于后续孪生网络输入。

孪生网络原理与相似度匹配策略

当需要判断多个小图标是否属于同一类型时,传统多分类网络会面临类别爆炸风险。孪生网络通过共享权重提取特征并计算余弦距离或欧氏距离来衡量相似度,巧妙解决了这一问题。它将两张图片作为一对输入,输出0或1标签表示是否相同,避免了为每种图标单独维护分类器。

训练数据构建时,将同类图标对和不同类图标对随机组合,标签分别为0和1。网络学习到的嵌入空间能让相似图片向量距离接近,不同图片距离拉远。这种方式特别适合验证码场景,因为图标类别可能随时变化,无需预先知道所有类别数量。

数据加载时采用自定义Dataset类,随机选择图片并左右切割成两部分。数据增强包括垂直翻转、水平翻转和尺寸缩放,能有效提升模型泛化能力。以下是Dataset实现示例:

from torch.utils.data import Dataset

import random

from PIL import Image

import torch

from torchvision import transforms

class SiameseDataset(Dataset):

def __init__(self, root_dir, transform=None):

self.image_paths = [os.path.join(root_dir, f) for f in os.listdir(root_dir)]

self.transform = transform

def __getitem__(self, index):

img_path = random.choice(self.image_paths)

img = Image.open(img_path).resize((120, 60))

img0 = img.crop((0, 0, 60, 60)).convert('L')

img1 = img.crop((60, 0, 120, 60)).convert('L')

label = int(img_path.split('_')[-1].replace('.jpg', ''))

if self.transform:

img0 = self.transform(img0)

img1 = self.transform(img1)

return img0, img1, torch.tensor([label], dtype=torch.float32)

def __len__(self):

return len(self.image_paths)

transform = transforms.Compose([transforms.RandomHorizontalFlip(), transforms.Resize((100, 100)), transforms.ToTensor()])这种配对方式让训练数据量成倍增长,模型能快速学会区分细微差异。

孪生网络模型架构与完整训练过程

模型主体由共享CNN特征提取器和后续全连接层组成。CNN部分使用反射填充和多层卷积加BatchNorm,确保特征鲁棒性。全连接层逐步降维至低维嵌入空间。推理时计算两嵌入向量的对比损失,常用对比损失函数能有效拉近正样本距离。

完整模型定义如下,包含前向传播逻辑:

import torch.nn as nn

class SiameseNetwork(nn.Module):

def __init__(self):

super().__init__()

self.cnn = nn.Sequential(

nn.ReflectionPad2d(1),

nn.Conv2d(1, 4, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(4),

nn.ReflectionPad2d(1),

nn.Conv2d(4, 8, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(8),

nn.ReflectionPad2d(1),

nn.Conv2d(8, 8, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(8)

)

self.fc = nn.Sequential(

nn.Linear(8 * 100 * 100, 500),

nn.ReLU(inplace=True),

nn.Linear(500, 500),

nn.ReLU(inplace=True),

nn.Linear(500, 5)

)

def forward_once(self, x):

output = self.cnn(x)

output = output.view(output.size(0), -1)

return self.fc(output)

def forward(self, input1, input2):

output1 = self.forward_once(input1)

output2 = self.forward_once(input2)

return output1, output2训练时使用DataLoader加载数据对,结合MarginRankingLoss优化。迭代50-100个epoch后,模型在验证集相似度判断准确率通常超过96%。实际项目中可添加学习率衰减和早停策略,进一步提升稳定性。

实际部署优化与云API集成方案

模型训练完毕后,可通过ONNX导出部署到生产环境,或使用Flask搭建本地推理服务。但对于需要快速上线且避免维护成本的团队,专业的验证码识别云平台是更优选择。例如www.ttocr.com专门针对极验和易盾图标点选提供高精度识别服务,通过简单HTTP API远程调用即可完成整个流程,无需自行搭建GPU服务器。

集成方式仅需几行代码:准备图片字节流,发送POST请求到平台接口,接收返回的JSON结果,其中包含图标坐标和匹配类型。平台支持高并发调用,响应时间控制在200毫秒以内,且允许上传自定义样本进一步微调模型。这让开发者能将精力集中在业务逻辑上,而非底层算法调优。

在高流量场景下,云API还能自动处理负载均衡和容错机制,确保识别服务24小时稳定运行。结合本地预处理与云端识别的混合架构,能同时兼顾隐私保护和计算效率。

高级优化技巧与长期维护建议

为进一步提升识别精度,可引入注意力机制增强CNN对关键区域的关注,或升级到YOLOv5等最新检测框架。定期收集新验证码样本重新训练模型,能有效应对服务商的算法更新。测试阶段采用交叉验证和混淆矩阵分析,确保模型在各种变形下的鲁棒性。

此外,结合图像预处理如自适应直方图均衡,能显著降低噪声影响。长期维护时建议建立自动化数据采集管道,每周补充新样本保持模型新鲜度。这些实践经验在实际项目中已帮助众多系统实现99%以上的成功率。