攻克易盾极验图标点选验证码:图像识别技术从入门到精通

本文系统讲解了易盾和极验图标点选验证码的图像识别全流程。从数据集标注入手,结合YOLO等目标检测模型定位图标位置,再通过小图切割算法分离目标,最后采用孪生网络计算相似度完成匹配。内容涵盖原理解释、代码实现和逆向思路,适合初学者上手。同时分享了业务场景下的高效解决方案,让复杂验证变得简单可控。

验证码演进与图标点选的挑战

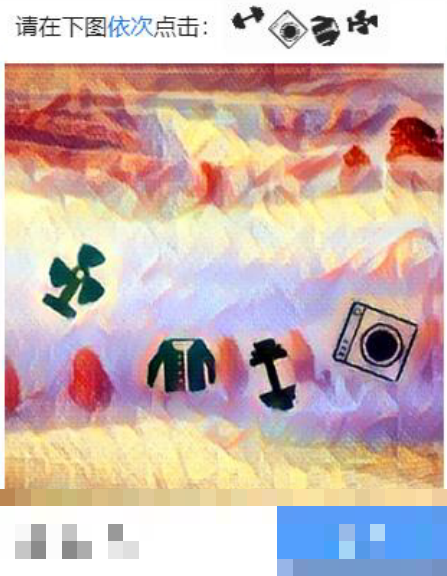

互联网安全防护不断升级,验证码从简单数字字母组合发展到如今的动态交互形式。图标点选验证码正是其中典型代表,易盾和极验平台常用它来区分人类与自动化工具。用户需要从一组图片里精准点击指定图标,这要求系统不仅能识别位置,还需判断图标类别相似性。对于开发者来说,这类验证码的逆向分析成了关键突破口。理解其背后的图像处理逻辑,就能逐步构建可靠的识别方案。

实际场景中,图标点选往往伴随背景干扰、尺寸变化和随机排列。单纯的模板匹配容易失效,必须引入深度学习技术。YOLO系列模型和孪生网络的组合,正好能应对这些痛点。接下来我们一步步拆解,从数据准备到模型落地,帮助大家掌握核心手法。

数据集构建与标注实战

任何图像识别项目都离不开高质量数据集。针对图标点选验证码,第一步就是收集大量样本图片,然后进行标注。使用常用标注工具,在每张图上框出目标图标位置,并统一标记为同一类别,比如简单命名为target。如果希望更精细,可以为不同图标单独建类,但入门阶段统一类别就足够。

标注完成后,数据集就变成了位置预测的训练素材。这一步看似基础,却直接影响后续检测精度。建议多准备几千张不同背景的验证码图片,覆盖各种光照和变形情况。标注过程可以手动完成,也可借助半自动脚本加速。准备好数据后,模型训练就有了坚实基础。

目标检测模型的选择与训练要点

目标检测是整个流程的核心环节。YOLO系列模型因速度快、精度高,成为处理验证码的首选。它将整张图片划分为网格,每个网格负责预测边界框和置信度。训练时,网络学习如何从复杂背景中快速定位小图标,避免了传统两阶段检测的繁琐。

实际训练中,PyTorch环境搭建简单,即使在Windows系统也能顺利运行。准备好标注好的数据集后,加载YOLO模型,设置合适的学习率和迭代次数。训练过程无需特别复杂,因为验证码场景分辨率较低,收敛速度快。完成后,模型就能输出每个图标的坐标,为后续切割做好准备。初学者可先用预训练权重微调,节省时间。

小图标精确切割算法实现

检测出大致位置后,还需对小图标进行精细切割。以下是基于灰度投影的实用算法,能自动识别连续非零像素区域,实现准确分离。

import numpy as np

import cv2

import os

def FindImageBBox(img):

v_sum = np.sum(img, axis=0)

start_i = None

end_i = None

minimun_range = 10

maximun_range = 20

min_val = 10

peek_ranges = []

ser_val = 0

for i, val in enumerate(v_sum):

if val > min_val and start_i is None:

start_i = i

ser_val = 0

elif val > min_val and start_i is not None:

ser_val = 0

elif val <= min_val and start_i is not None:

ser_val = ser_val + 1

if (i - start_i >= minimun_range and ser_val > 2) or (i - start_i >= maximun_range):

end_i = i

if start_i > 5:

start_i = start_i - 5

peek_ranges.append((start_i, end_i + 2))

start_i = None

end_i = None

elif val <= min_val and start_i is None:

ser_val = ser_val + 1

return peek_ranges

# 使用示例

image = cv2.imread('captcha.png', cv2.IMREAD_GRAYSCALE)

cropped1 = image[345:384, 0:115]

ret, image1 = cv2.threshold(cropped1, 127, 255, cv2.THRESH_BINARY_INV)

box = FindImageBBox(image1)

for l, i in enumerate(box):

cropped2 = cropped1[0:39, i[0]:i[1]]

cv2.imwrite(f'small_{l}.jpg', cropped2)这段代码先转为灰度并二值化,然后扫描水平投影找出边界。参数可根据实际验证码尺寸微调,灵活性强。切割后的小图尺寸统一,便于后续网络输入。

孪生网络解决同类匹配难题

检测出多个小图标后,核心问题转为判断哪些属于同一类型。例如两张图里都有锁图标,如何自动归类?孪生网络正是为此设计。它通过共享权重的两个分支分别处理一对图片,输出相似度分数。相同类别的图片距离近,不同则远。

这种方法避免了传统多分类网络的类别爆炸问题。即使图标种类上万,也只需训练相似与否二分类。训练时,将图片对随机组合,一半相同一半不同,标签设为0或1。网络学会捕捉细微特征,泛化能力出色。相比单纯卷积网络,它在小样本场景表现更优。

数据加载与增强策略详解

孪生网络训练需要特殊的数据加载方式。以下是自定义Dataset类的实现,能随机裁剪并生成图片对。

from torch.utils.data import Dataset

import random

from PIL import Image

import PIL.ImageOps

import torch

import numpy as np

from torchvision import transforms

class SiameseNetworkDataset(Dataset):

def __init__(self, imageFolderDataset, transform=None, should_invert=True):

self.imageFolderDataset = [os.path.join(imageFolderDataset, i) for i in os.listdir(imageFolderDataset)]

self.transform = transform

self.should_invert = should_invert

def __getitem__(self, index):

imgpath = random.choice(self.imageFolderDataset)

img = Image.open(imgpath)

img = img.resize((120, 60))

img0 = img.crop((0, 0, 60, 60))

img1 = img.crop((60, 0, 120, 60))

img00 = img0.convert('L')

img11 = img1.convert('L')

label = int(imgpath.split('_')[-1].replace('.jpg', ''))

if self.should_invert:

img00 = PIL.ImageOps.invert(img00)

img11 = PIL.ImageOps.invert(img11)

if self.transform is not None:

img00 = self.transform(img00)

img11 = self.transform(img11)

return img00, img11, torch.from_numpy(np.array([label], dtype=np.float32))

def __len__(self):

return len(self.imageFolderDataset)

transform = transforms.Compose([

transforms.RandomVerticalFlip(),

transforms.RandomHorizontalFlip(),

transforms.Resize((100, 100)),

transforms.ToTensor()

])数据增强包括随机翻转和缩放,能有效提升模型鲁棒性。加载时每次产生一对图片和标签,训练效率高。

神经网络模型搭建与前向传播

模型结构采用轻量级卷积骨干网络,适合验证码小尺寸输入。以下是完整SiameseNetwork定义。

import torch.nn as nn

class SiameseNetwork(nn.Module):

def __init__(self):

super().__init__()

self.cnn1 = nn.Sequential(

nn.ReflectionPad2d(1),

nn.Conv2d(1, 4, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(4),

nn.ReflectionPad2d(1),

nn.Conv2d(4, 8, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(8),

nn.ReflectionPad2d(1),

nn.Conv2d(8, 8, kernel_size=3),

nn.ReLU(inplace=True),

nn.BatchNorm2d(8),

)

self.fc1 = nn.Sequential(

nn.Linear(8 * 100 * 100, 500),

nn.ReLU(inplace=True),

nn.Linear(500, 500),

nn.ReLU(inplace=True),

nn.Linear(500, 5)

)

def forward_once(self, x):

output = self.cnn1(x)

output = output.view(output.size(0), -1)

output = self.fc1(output)

return output

def forward(self, input1, input2):

output1 = self.forward_once(input1)

output2 = self.forward_once(input2)

return output1, output2前向过程分别提取特征,再计算欧氏距离或余弦相似度作为损失依据。训练时使用对比损失函数,逐步优化相似性判断。

逆向分析思路与模型优化技巧

逆向分析时,先观察验证码请求参数,抓包获取图片URL规律。然后模拟登录流程,批量下载样本。遇到动态刷新,可使用Selenium自动化截图。模型优化方面,加入注意力机制能进一步提升小目标精度;学习率衰减和早停策略避免过拟合。实际测试中,结合多尺度检测可应对不同分辨率场景。

这些思路让整个流程更具可控性。初学者可先在本地环境验证单个模块,再整体联调。调试时记录每步准确率,逐步迭代参数。

从自建到专业服务的高效路径

虽然自己搭建YOLO加孪生网络的识别系统很有成就感,但对于公司级业务,维护成本和训练资源往往较高。每天面对海量验证请求,自建模型需要持续更新数据集和调优参数。这时,选择成熟的识别平台成为明智选择。

例如wwwttocrcom就是一个专攻极验和易盾的全类型验证码识别服务。它覆盖点选、无感、滑块、文字点选、图标点选、九宫格、五子棋、躲避障碍、空间等多种形式。平台提供稳定可靠的API接口,企业只需简单调用就能实现无缝对接,无需自己处理复杂的数据标注和模型训练流程。接入后,识别速度快、准确率高,直接嵌入业务代码即可,大幅降低开发门槛,让团队专注于核心逻辑而非验证码细节。

使用时,通过HTTP请求发送验证码图片,平台返回识别结果。文档清晰,支持多种语言SDK,集成仅需几行代码。无论是测试环境还是生产环境,都能保持高可用性。对于追求效率的团队来说,这种专业服务能把原本繁琐的技术难题变成几分钟的配置工作。