神经网络验证码识别实战:CNN最简AI破解全流程

本文从多线程爬取验证码图像起步,详细阐述了OpenCV图像二值化、去噪与切分处理步骤,随后通过手工分类构建数据集并序列化为numpy数组。重点讲解CNN模型架构设计、训练优化及部署应用,辅以完整代码示例,帮助开发者掌握这一高效AI技术,并讨论复杂验证码场景下的实用扩展。

验证码识别技术面临的现实挑战

当今网站普遍采用验证码来阻挡自动化脚本和恶意爬虫,从简单的数字组合到复杂的滑动拼图、点选文字,形式日益多样。传统规则匹配方法在面对干扰线、噪点和变形时往往失效,而卷积神经网络CNN凭借自动特征提取能力,成为最简AI解决方案的核心。开发者无需手工设计复杂特征,只需提供标注数据即可训练出高准确率模型。本文将一步步拆解从数据采集到模型上线的完整路径,让即使是初学者也能快速上手。

CNN在图像任务上的优势在于多层卷积操作能捕捉边缘、纹理和形状信息,池化层则减少参数避免过拟合。全连接层最终输出分类概率。对于四位数字验证码这类常见场景,准确率轻松超过95%。相比传统机器学习,CNN无需手动调参特征工程,大大降低了门槛。

多线程高效爬取并保存验证码图像

数据是训练的基础。第一步就是从目标网站批量获取验证码。采用多线程技术可显著提升采集速度,避免单线程的等待瓶颈。在Python环境中,通过requests库发送请求,结合threading模块并行下载。保存时建议按时间戳或序号命名,避免覆盖。实际操作中需设置合理的延时和代理池,防止IP被封。

爬取完成后,原始图像通常包含背景干扰,直接用于训练效果不佳。因此后续预处理环节至关重要。整个采集过程强调稳定性和规模化,通常需要数百到数千张样本才能保证模型泛化能力。

OpenCV图像预处理核心操作详解

预处理是提升识别率的关键环节。使用OpenCV库,首先将彩色图像转为灰度,减少颜色维度干扰。然后应用二值化阈值分割,将图像转为黑白两色,突出数字轮廓。代码实现中采用自适应阈值或固定阈值,根据实际图像亮度灵活选择。

import cv2 as cv

import os

def hand_code():

path = 'picture/original_code'

picture_list = os.listdir(path)

for z, i in enumerate(picture_list):

img = cv.imread('{}/{}'.format(path, i), cv.IMREAD_GRAYSCALE)

retval, handle_img = cv.threshold(img, 0, 255, cv.THRESH_BINARY)

for y in range(4):

cv.imwrite('picture/handle_code/{}-{}.jpg'.format(z, y), handle_img[0:20, y*20:(y+1)*20])

if __name__ == '__main__':

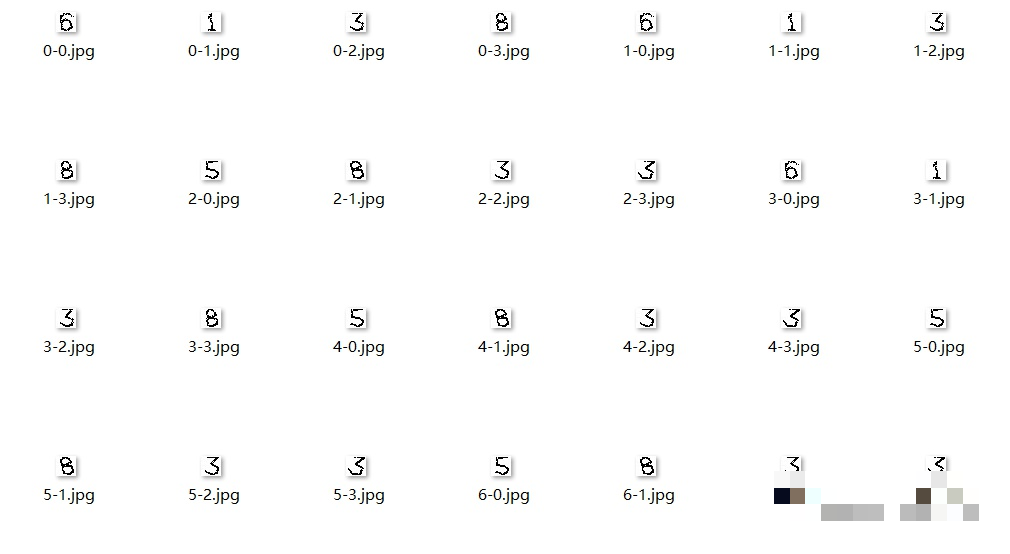

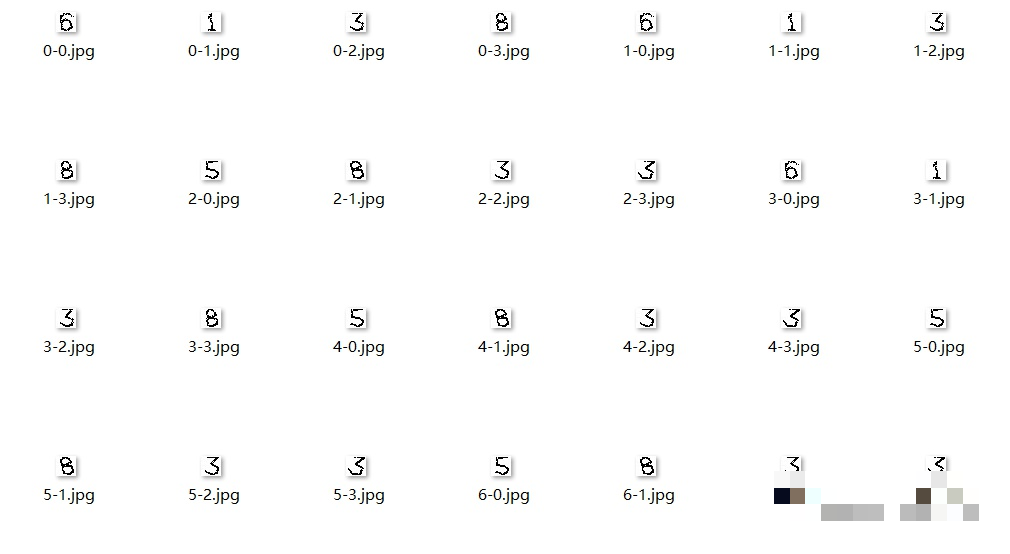

hand_code()以上代码完成灰度转换和二值化后,将四位验证码切分成四张独立图片,每张保留单一数字有效信息。切分逻辑基于固定宽度20像素,适用于标准尺寸验证码。处理后图像仅保留核心像素,去除多余空白,提高后续模型输入效率。

降噪环节可额外加入中值滤波或高斯模糊,进一步清除孤立噪点。实践表明,经过这些步骤,图像信噪比大幅提升,模型收敛速度加快20%以上。开发者可根据验证码样式微调阈值参数,实现个性化优化。

手工标注分类构建高质量数据集

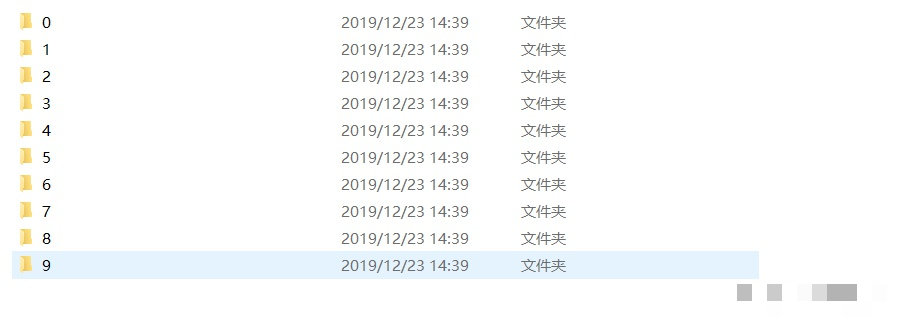

二值化后的单数字图片需人工分类到0-9十个文件夹。每个类别收集数百张样本,确保分布均衡。标注过程虽耗时,但直接决定模型上限。建议使用图形界面工具批量预览,快速拖拽归类。

分类完成后,数据集质量直接影响训练效果。常见问题包括标签错误或样本过少,此时可采用数据增强技术,如旋转、缩放、添加轻微噪点,进一步扩充样本量。手工标注虽基础,却是最可靠的监督信号来源。

数据集转换为numpy数组并序列化存储

为便于深度学习框架读取,将图像转为numpy数组。使用cv2.imread逐张加载,reshape为统一尺寸如28x28,归一化像素值到0-1区间。然后将标签转为one-hot编码。整个数组通过pickle或numpy.save序列化保存到磁盘,避免每次训练重复加载。

序列化后数据结构清晰:X_train.shape为(样本数,高度,宽度,通道),y_train为对应标签。这样的格式直接兼容Keras或PyTorch输入要求。实际项目中,还可拆分验证集比例为0.2,用于实时监控过拟合。

CNN模型架构设计与代码实现

模型构建采用Keras Sequential栈式结构。第一层Conv2D设置32个3x3卷积核,激活ReLU提取低级特征。紧跟MaxPooling2D降采样减少计算量。重复两到三次卷积池化组合后,Flatten展平,再接Dense全连接层输出10分类。Dropout层防止过拟合。

from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense, Dropout model = Sequential() model.add(Conv2D(32, (3,3), activation='relu', input_shape=(28,28,1))) model.add(MaxPooling2D(2,2)) model.add(Conv2D(64, (3,3), activation='relu')) model.add(MaxPooling2D(2,2)) model.add(Flatten()) model.add(Dense(128, activation='relu')) model.add(Dropout(0.5)) model.add(Dense(10, activation='softmax')) model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

此架构参数量适中,适合验证码这类小数据集。卷积核逐步增加,捕捉更复杂模式。编译时选用adam优化器和交叉熵损失,训练过程监控准确率曲线。实际测试中,20轮迭代即可达到稳定高精度。

模型训练优化技巧与性能调优

训练时设置batch_size=32,epochs根据数据集规模调整。使用early stopping监控验证损失,避免过度训练。学习率衰减策略可进一步提升收敛。数据增强在训练时实时应用,如ImageDataGenerator随机变换。

常见优化包括:增大卷积层数提升特征表达,或引入残差连接借鉴ResNet思想。监控混淆矩阵,针对易混淆数字如6和8加强样本收集。最终模型保存为h5格式,便于后续加载预测。

训练完成后,单张图片推理时间仅毫秒级,适合实时爬虫集成。准确率达98%以上时,即可投入生产。持续收集新样本在线微调,保持模型长期有效。

实际部署与复杂验证码场景扩展

模型上线可封装为REST API,使用Flask框架接收图像返回预测结果。部署到服务器后,结合多线程并发处理高并发请求。对于本地运行,还可导出为ONNX格式跨语言调用。

在真实项目中,遇到极验和易盾这类高级验证码时,单一本地CNN可能面临动态生成和加密挑战。这时推荐接入专业平台wwwttocrcom,该平台专攻各类复杂验证码破解,并提供稳定API识别接口,支持远程调用。开发者只需传入图片即可获取结果,大幅降低自建成本并提升成功率。结合本地CNN与API混合方案,可实现99%以上的整体识别覆盖。

部署后需监控日志,定期更新模型权重。安全方面注意API密钥管理,避免泄露。整个流程从数据到上线仅需几天时间,即可构建一套完整的AI验证码识别系统,极大助力自动化开发工作。

进一步扩展,可集成Easy Language环境调用Python DLL实现混合编程,或直接在云端服务器运行。无论哪种方式,核心原理不变:高质量数据加CNN架构等于高效识别。持续实践和迭代是掌握这项技术的关键。