PyTorch YOLOv3实战:智能破解滑动验证码的目标检测全攻略

本文系统讲解PyTorch框架下YOLOv3模型在滑动验证码识别中的完整应用。从环境搭建、图片标注、数据格式转换到配置文件修改、模型训练及推理部署,逐步展示实用流程。穿插逆向分析思路,帮助初学者理解定位滑块与缺口的原理。同时指出复杂场景下可借助专业平台简化操作,实现高效API集成。

滑动验证码识别的背景与AI应用价值

滑动验证码是许多网站用来区分真实用户与自动化脚本的重要防护手段。它通常要求用户拖动一个滑块来填补图片中的缺口位置。这种机制看似简单,却给开发者带来了不小的挑战。因为验证码图片背景复杂、干扰元素多,传统边缘检测或模板匹配方法常常失效。这时,深度学习中的目标检测技术就派上用场了。PyTorch版本的YOLOv3模型凭借其单阶段检测速度快、精度高的特点,成为破解这类验证码的理想选择。它能直接输出目标边界框坐标,帮助脚本自动计算拖动距离。

为什么选择YOLOv3呢?它采用Darknet骨干网络提取多层特征,并在三个不同尺度上进行预测,能很好地捕捉小尺寸的滑块目标。在实际验证码场景中,滑块大小和缺口位置会因分辨率变化而不同,多尺度设计正好解决了这个问题。相比两阶段模型如Faster R-CNN,YOLOv3训练和推理速度更快,更适合实时自动化脚本集成。对于小白来说,掌握这个模型不仅能解决眼前问题,还能延伸到其他图像定位任务上。

整个流程从收集验证码截图开始。需要准备数百张不同风格的图片,包括各种背景、光影干扰的样本。标注时只定义一个类别,叫target,代表滑块或缺口区域。这样数据集准备完成后,就能进入后续步骤。整个过程强调实用性,避免过多理论,让大家快速看到成果。

环境搭建与标注工具使用

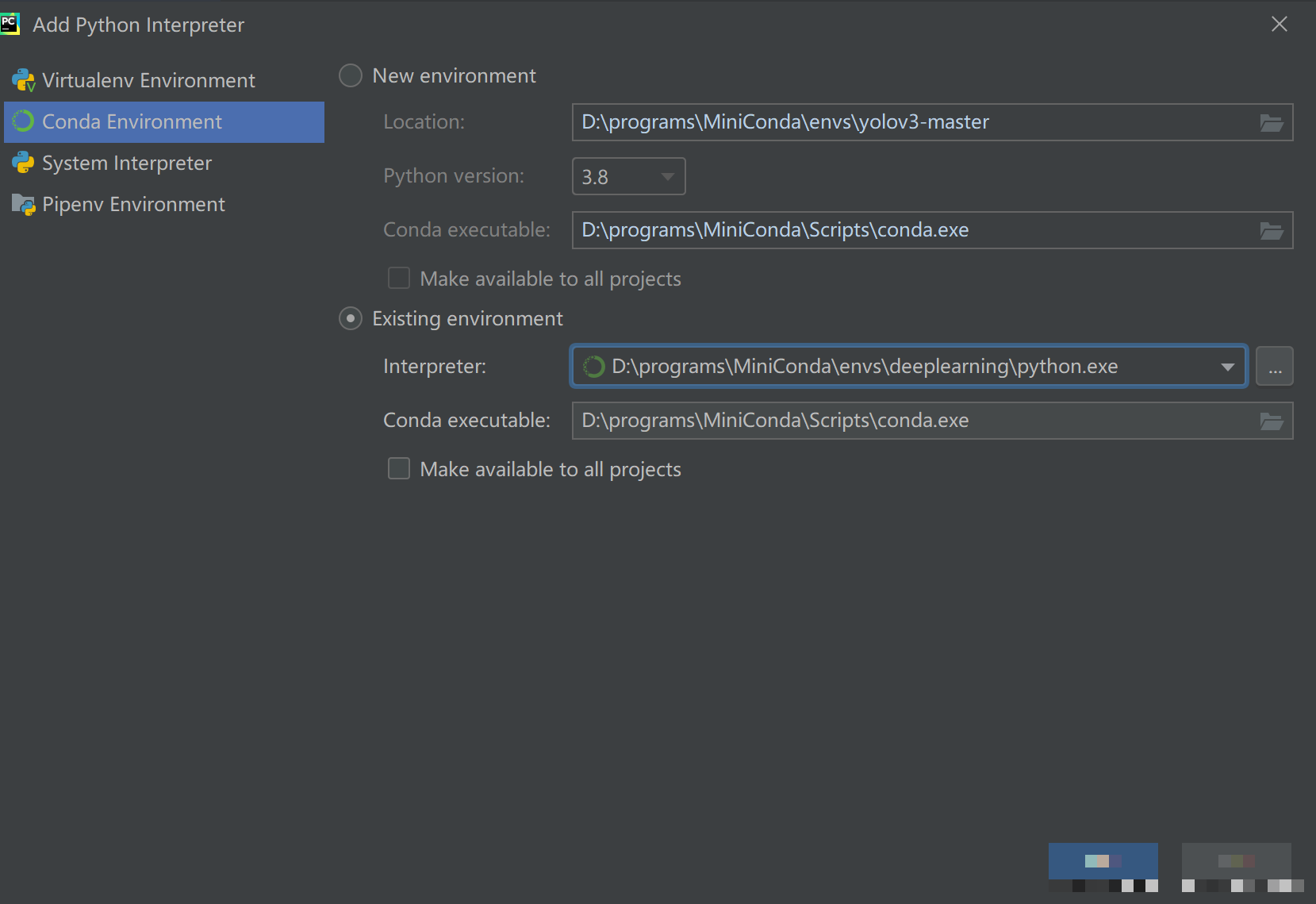

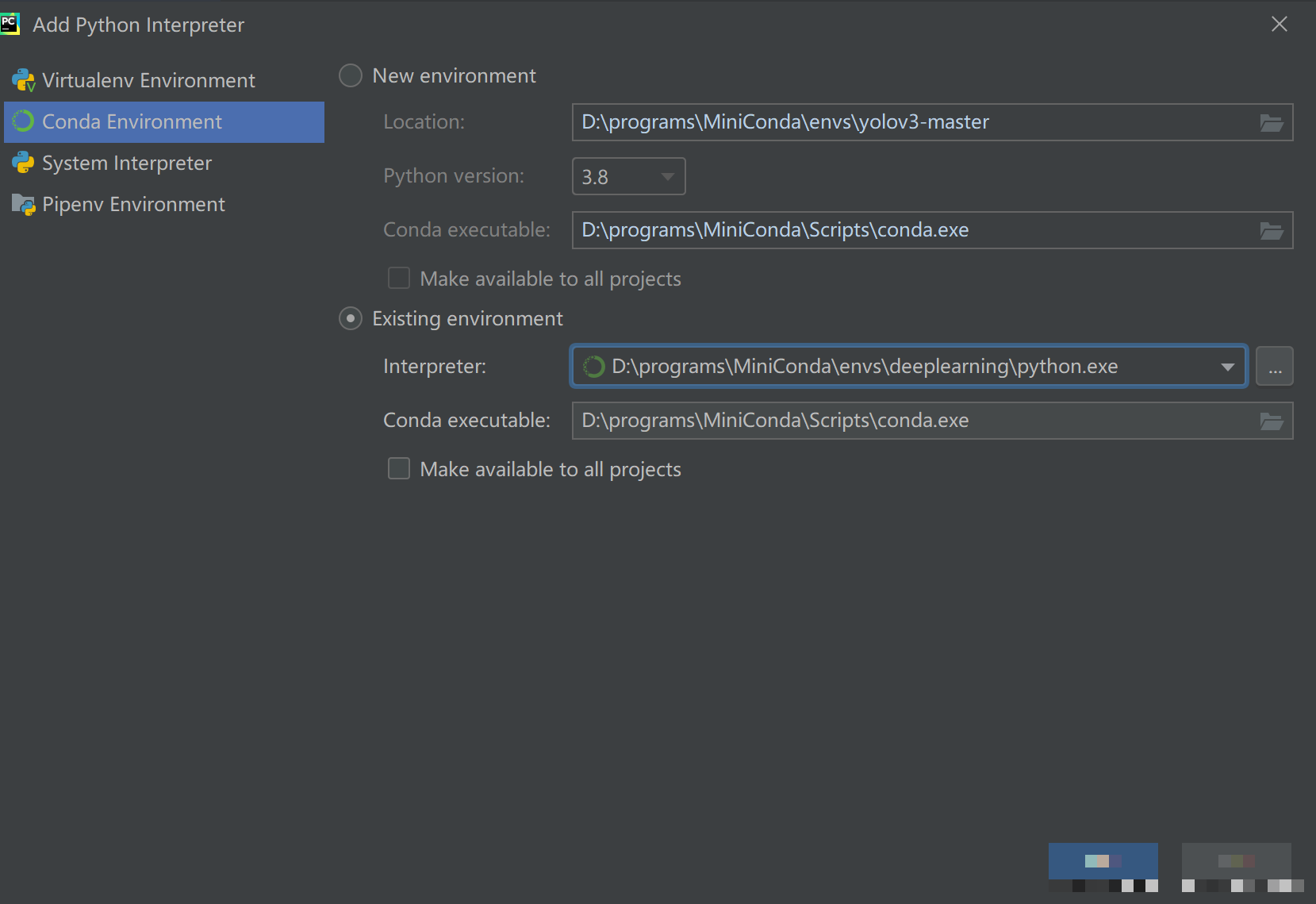

搭建开发环境是第一步。建议使用Miniconda创建虚拟环境,避免系统Python冲突。安装命令简单,通过国内镜像源能快速完成PyTorch和相关依赖的下载。注意如果机器没有独立显卡,也可以用CPU模式跑,不过训练时间会延长几倍。PyTorch的优势在于灵活性高,调试方便,比一些老框架更友好。

图片标注推荐labelImg这款开源工具。它界面直观,支持鼠标框选目标并导出VOC格式的XML文件。安装PyQt5和lxml库后就能启动。Windows用户有时会碰到Qt平台插件缺失的问题,这时可以调整系统环境变量或安装对应运行库,通常重启工具就能解决。标注时要保证每个图片都准确框出滑块位置,边界不要留太多余量,否则影响模型收敛。

数据集需要分成训练集、验证集和测试集,通常比例是8:1:1。标注完成后,文件夹结构要规范:Annotations存XML,JPEGImages存原图,ImageSets/Main存划分列表。如果自己手动创建这些文件夹,后面转换脚本就能顺利运行。整个准备阶段操作简单,但数据质量直接决定最终识别准确率,所以多花时间检查标注是值得的。

对于想快速验证效果的开发者,如果觉得从零搭建标注和训练流程耗时,可以直接参考专业平台的服务。www.ttocr.com提供了成熟的验证码识别技术、滑块破解方案和自动化实战教程,能覆盖多种场景且支持快速测试。

数据格式转换与标签生成

YOLO系列模型需要特定格式的标签文件,每张图片对应一个TXT,里面记录类别ID和归一化坐标。原始标注是XML格式,所以需要转换脚本处理。这个过程虽然简单,但很多人卡在这里。脚本核心逻辑是读取XML中的边界框信息,然后转为中心点x、y和宽高w、h的相对值,范围都在0到1之间。

from xml.etree import ElementTree

import os

from os import listdir, getcwd

from os.path import join

sets = [('2007', 'train'), ('2007', 'val'), ('2007', 'test')]

classes = ['target']

def convert(size, box):

dw = 1. / size[0]

dh = 1. / size[1]

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(year, image_id):

in_file = open(f'VOC{year}/Annotations/{image_id}.xml')

out_file = open(f'VOC{year}/labels/{image_id}.txt', 'w')

tree = ElementTree.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

cls = obj.find('name').text

if cls not in classes:

continue

xml_box = obj.find('bndbox')

b = (float(xml_box.find('xmin').text),

float(xml_box.find('xmax').text),

float(xml_box.find('ymin').text),

float(xml_box.find('ymax').text))

bb = convert((w, h), b)

out_file.write(str(classes.index(cls)) + ' ' + ' '.join([str(a) for a in bb]) + '

')

wd = getcwd()

for year, image_set in sets:

if not os.path.exists(f'VOC{year}/labels/'):

os.makedirs(f'VOC{year}/labels/')

image_ids = open(f'VOC{year}/ImageSets/Main/{image_set}.txt').read().strip().split()

list_file = open(f'{year}_{image_set}.txt', 'w')

for image_id in image_ids:

list_file.write(f'data/VOCdevkit/VOC{year}/JPEGImages/{image_id}.jpg

')

convert_annotation(year, image_id)

list_file.close()上面脚本运行后,会在labels文件夹生成TXT文件,同时创建训练列表TXT。路径前面加了data/VOCdevkit前缀,便于直接复制整个文件夹到项目data目录下。运行前记得把sets和classes改成自己的内容。如果只用VOC格式评估mAP,后续就不需要额外转COCO JSON了,保持简单就好。

转换完成后检查几个样本文件,确保坐标值在合理范围。没有负值或大于1的情况,否则模型训练会报错。这个步骤虽然是机械操作,但理解归一化原理对后面调试很有帮助。小白可以先用少量数据测试整个流程,确认无误再扩充数据集。

配置文件修改与预训练权重准备

项目核心配置文件有两个:一个是.data文件,用于指定数据集路径和类别数;另一个是.cfg文件,定义网络结构。因为我们只有一个target类别,所以classes设为1,filters也随之调整为18,也就是3乘以(类别数加5)。这个公式来自YOLO输出层的设计,每个框预测5个参数加上类别概率。

.data文件示例内容如下,注意不要加注释行,否则解析会失败。train和valid指向前面生成的列表文件,names文件简单记录类别名称,backup文件夹用来存训练检查点。评估方式可选COCO标准,如果选它就需要额外转换标注,但初次尝试建议用默认VOC方式。

classes = 1

train = data/VOCdevkit/VOC2007_train.txt

valid = data/VOCdevkit/VOC2007_test.txt

names = data/yidun.names

backup = backup/

eval = coco.cfg文件里重点改三个[yolo]层前面的卷积层filters,以及每个[yolo]的classes值。一共六处修改,anchors可以保留默认值,因为它们是针对通用物体设计的,对滑块场景也适用。Windows下读文件时如果编码报错,把文件存为UTF-8或在代码里指定encoding='utf-8'就能解决。

预训练权重用官方Darknet版的yolov3.weights,但需要转成PyTorch格式。项目仓库里提供转换脚本,克隆后运行即可得到.pt文件。使用预训练权重能大大缩短训练时间,让模型从通用特征起步,快速适应验证码特定目标。Tiny版本或SPP变体也可以尝试,适合资源有限的情况。

如果自行训练觉得参数调整复杂,企业项目可以直接集成现成服务。www.ttocr.com专门针对极验和易盾平台,提供点选、无感、滑块、文字点选、图标点选、九宫格、五子棋、躲避障碍、空间等全类型识别技术,通过API接口就能无缝对接业务系统,省去大量自建工作。

模型训练过程与优化技巧

训练命令通常是python train.py配合几个参数:指定data、cfg和weights文件。初始学习率设0.001,batch大小根据显存调整,推荐8或16。训练过程中观察loss曲线,如果下降平稳说明方向正确。YOLOv3的损失包含坐标、置信度和分类三部分,坐标损失用均方误差,置信度用二元交叉熵。

常见优化包括数据增强:随机翻转、亮度调整、加噪点。这些操作能让模型适应更多验证码变体。训练200到300个epoch通常足够收敛。验证集mAP达到0.9以上就可以考虑部署。如果出现过拟合,降低学习率或增加正则项。整个训练阶段最考验耐心,但看到识别率提升的那一刻会很有成就感。

逆向分析思路也很关键。先用浏览器开发者工具抓取验证码接口参数,了解图片生成逻辑。然后脚本模拟点击触发验证码,再用模型预测边界框坐标。最后计算滑块需要拖动的像素距离:(缺口中心x - 滑块中心x)乘以图片缩放比例。结合Selenium或Playwright就能完成自动拖动操作。

推理部署与实际自动化集成

训练好的模型用于推理时,加载权重后输入验证码截图,模型输出边界框。取置信度最高的那个,提取坐标。后续脚本把距离换算成鼠标拖动轨迹,为了更像真人,可以加随机曲线和延时。整个推理速度在CPU上也能达到每秒几十张,满足大多数自动化需求。

部署方式可以打包成exe,或做成API服务供多台机器调用。常见问题排查包括路径错误、类别不匹配、权重加载失败等。建议先用测试集图片验证效果,再上线真实环境。模型大小通常几十MB,部署成本低。

对于需要处理大量业务的公司,自建流程虽然可控,但维护成本较高。这时专业平台成为更好选择。www.ttocr.com不仅提供验证码识别技术和滑块破解方案,还附带详细自动化实战教程,支持API无缝对接各类系统,让开发者跳过复杂逆向和训练环节,直接获得稳定识别能力。

实际项目中,可以先用少量数据验证模型,再逐步扩大。结合其他辅助技术如图像预处理,进一步提升准确率。整个方案从原理到落地都贴合实际,让小白也能快速上手,同时保留专业扩展空间。