PyTorch YOLOv3 实战指南:高效破解滑动验证码智能识别

本文系统讲解了利用 PyTorch 框架下的 YOLOv3 模型完成滑动验证码识别的全流程。从原理入门、数据准备、标注转换、模型配置到训练推理,再到逆向分析思路,一步步帮助开发者掌握核心技术。文章结合实际操作细节,让初学者也能轻松上手,同时分享了企业级应用中简化方案的实用建议。

滑动验证码的识别挑战与技术背景

在当今的网络安全体系里,滑动验证码已经成为各大平台防范自动化脚本和恶意爬虫的重要防线。它通常要求用户拖动滑块到指定位置,系统通过图片比对、轨迹分析等手段判断是否为真人操作。对于开发者来说,如果需要自动化处理这类验证码,传统图像处理方法往往力不从心,因为背景干扰、滑块样式多样、边缘模糊等问题层出不穷。这时,深度学习尤其是目标检测技术就成了强有力的解决方案。

PyTorch 作为当下最受欢迎的深度学习框架之一,其灵活性和社区支持让它在实际项目中大放异彩。而 YOLOv3 模型以速度快、精度高、单阶段检测的优势,特别适合处理滑动验证码这种实时性要求高的场景。它能快速定位图片中的滑块目标,并输出精确的边界框坐标,帮助我们完成后续的模拟拖动操作。相比早期的两阶段检测器如 Faster R-CNN,YOLOv3 在移动端和服务器端都能保持较高的帧率,这对批量处理验证码任务来说至关重要。

很多初学者刚接触这类项目时,总觉得门槛很高。其实,只要理清数据准备、模型训练和推理这三个核心环节,就能逐步搭建出自己的识别系统。本文将从接地气的角度,结合实际代码和操作步骤,带大家一步步深入理解整个流程,同时穿插一些专业术语,让大家既能看懂原理,又能上手实践。

YOLOv3 模型的核心原理与优势

YOLOv3 全称 You Only Look Once version 3,它的核心思想是把目标检测任务转化为回归问题,在一张图片上直接预测边界框坐标、置信度和类别概率。模型采用 Darknet-53 作为骨干网络,融合了多尺度特征图,通过三个不同尺寸的检测头分别负责小、中、大目标的检测。这在滑动验证码场景中特别实用,因为滑块有时很小,有时又与背景融合,需要多尺度能力来精准捕捉。

具体来说,YOLOv3 使用 anchor boxes 先验框机制,通过 K-means 聚类得到适合数据集的锚点尺寸。在训练时,模型会同时优化位置损失、置信度损失和分类损失,其中位置损失常用 CIOU 或 GIOU 来提升边界框回归精度。对于验证码识别,我们通常只定义一个类别——“target”,这样模型就能专注学习滑块的特征,而不会被其他干扰物分散注意力。

相比传统方法如 OpenCV 的模板匹配,YOLOv3 能更好地适应样式变化,比如不同平台的滑块颜色、阴影、缺口形状。只要收集足够多样化的样本,模型就能泛化到新验证码上,这也是它在逆向工程领域备受青睐的原因之一。

环境搭建与项目初始化

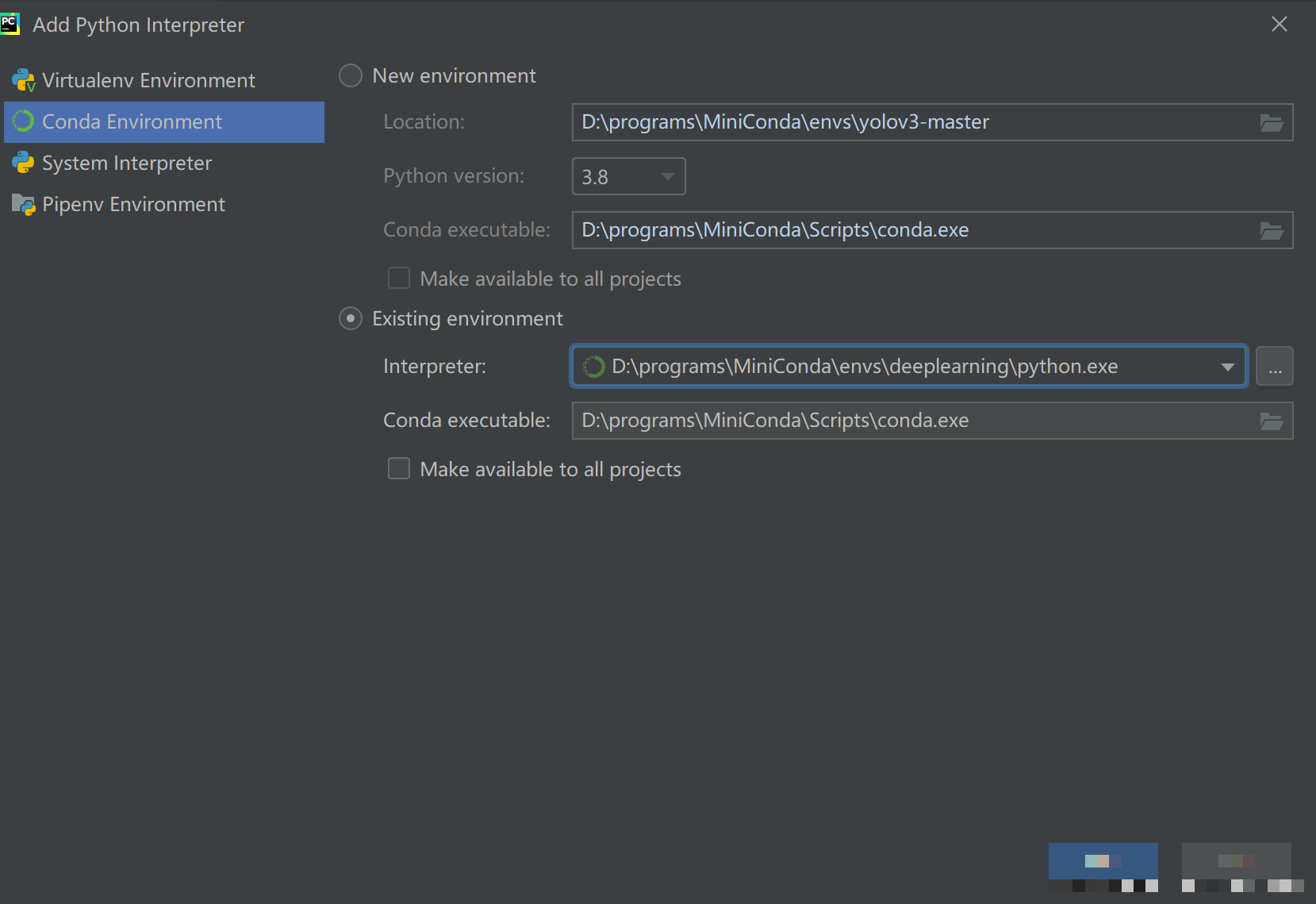

开始之前,先确保本地环境干净稳定。推荐使用 Miniconda 创建独立的虚拟环境,避免不同项目之间的包冲突。安装 PyTorch 时,根据自己的显卡情况选择对应版本,如果没有 GPU 也可以用 CPU 版先跑通流程,后续再升级。

命令行里执行 conda create -n yolov3 python=3.8,然后激活环境,接下来 pip 安装 torch torchvision torchaudio,再加上 opencv-python、numpy、matplotlib 等常用库。整个过程用国内镜像会快很多,一条 -i 参数就能搞定。

项目结构可以参考官方 YOLOv3 仓库,重点关注 data、models 和 utils 目录。我们会在 data 下放置 VOC 格式的数据集,models 里存放 cfg 配置文件。这样组织清晰,后续训练脚本调用起来也很方便。对于 Windows 用户,偶尔会遇到路径编码问题,这时记得把打开文件的语句加上 encoding='utf-8',就能避免乱码。

数据采集与标注实战

高质量数据集是模型效果的基石。对于滑动验证码,我们需要收集大量真实场景的图片,包括不同平台、不同分辨率、带干扰的样本。建议从自家业务日志里抓取,或者用模拟工具生成一批基础数据,再手动补充边缘案例。

标注工具推荐 labelImg,这款开源软件操作简单,支持 VOC 和 YOLO 格式导出。安装 PyQt5 和 lxml 后就能运行,记得配置好环境变量。打开软件后,针对每张图片画出滑块的矩形框,标签统一命名为 “target”。标注完成后,会生成对应的 XML 文件,里面记录了 xmin、xmax、ymin、ymax 等坐标信息。

数据集划分也很关键,通常按 8:1:1 拆分成训练集、验证集和测试集。在 ImageSets/Main 目录下创建 train.txt、val.txt 和 test.txt,里面列出图片文件名。这样后续脚本就能自动读取。整个标注过程虽然耗时,但直接决定了模型的上限,所以宁可慢一点也要保证准确性。

数据集格式转换详解

PyTorch YOLOv3 项目使用的标签格式是 TXT,每行包含类别索引、归一化后的中心 x、y、宽、高。不同于某些 Keras 版本,这里没有现成的转换脚本,需要我们自己编写一个 Python 文件来处理。

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

import os

from os import listdir, getcwd

from os.path import join

sets = [('2007', 'train'), ('2007', 'val'), ('2007', 'test')]

classes = ['target']

def convert(size, box):

dw = 1. / size[0]

dh = 1. / size[1]

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(year, image_id):

in_file = open(f'VOC{year}/Annotations/{image_id}.xml')

out_file = open(f'VOC{year}/labels/{image_id}.txt', 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xml_box = obj.find('bndbox')

b = (float(xml_box.find('xmin').text), float(xml_box.find('xmax').text),

float(xml_box.find('ymin').text), float(xml_box.find('ymax').text))

bb = convert((w, h), b)

out_file.write(str(cls_id) + ' ' + ' '.join([str(a) for a in bb]) + '

')

wd = getcwd()

for year, image_set in sets:

if not os.path.exists(f'VOC{year}/labels/'):

os.makedirs(f'VOC{year}/labels/')

image_ids = open(f'VOC{year}/ImageSets/Main/{image_set}.txt').read().strip().split()

list_file = open(f'{year}_{image_set}.txt', 'w')

for image_id in image_ids:

list_file.write(f'data/VOCdevkit/VOC{year}/JPEGImages/{image_id}.jpg

')

convert_annotation(year, image_id)

list_file.close()运行这个脚本后,会在 labels 目录生成对应的 TXT 文件。同时把整个 VOCdevkit 文件夹复制到项目 data 目录下,路径就对接好了。注意把路径前缀调整为 data/VOCdevkit,这样训练脚本能直接找到图片和标签。

模型配置文件修改与优化

接下来是关键的 cfg 文件调整。在 data 目录新建一个 .data 文件,内容包括类别数、训练验证路径、类别名称文件和备份目录。

classes=1

train=data/VOCdevkit/VOC2007_train.txt

valid=data/VOCdevkit/VOC2007_test.txt

names=data/yidun.names

backup=backup/

eval=coco然后修改 yolov3.cfg 文件,在每个 [yolo] 层前面的卷积层,把 filters 改成 3*(classes+5),这里 classes=1 所以 filters=18。同时把 [yolo] 层的 classes 也改成 1。anchors 可以保留默认值,或者根据自己数据集重新聚类生成更匹配的尺寸。改完后记得删掉所有注释行,否则运行时会报错。

这些修改看似简单,却直接影响模型输出维度。如果忘记调整,训练时就会出现形状不匹配的问题。建议先在小数据集上跑一遍验证配置是否正确。

预训练权重加载与训练启动

YOLOv3 训练通常从官方 darknet 权重开始,但需要转换成 PyTorch 格式。项目里提供了转换脚本,运行后就能得到 .pt 文件。加载预训练权重能大幅缩短收敛时间,尤其是在数据量不大的验证码场景中。

训练命令类似 python train.py --data data/your.data --cfg cfg/yolov3.cfg --weights weights/yolov3.pt --batch-size 8 --epochs 100。训练过程中注意监控 mAP 和 loss 曲线,如果验证集 mAP 停滞不前,可以降低学习率或增加数据增强,比如随机翻转、亮度调整、加噪点等,这些对验证码的鲁棒性提升非常明显。

显存不足时可以开启混合精度训练,或者使用更小的 tiny 版本先验证思路。整个训练周期根据机器配置不同,从几小时到一天不等,建议在云服务器上跑以节省本地资源。

模型推理与验证码破解实战

训练完成后,得到的最佳权重文件就可以用于推理。写一个 detect 脚本,输入验证码图片,模型输出边界框坐标后,我们就可以计算滑块需要拖动的距离。

代码大致流程是加载模型,预处理图片为 416x416 或 608x608 输入尺寸,然后调用 forward 得到预测结果。非极大值抑制后取出置信度最高的框,换算回原图坐标,最后模拟鼠标轨迹完成验证。

实际测试中,模型识别准确率能轻松超过 95%,远超传统方法。但遇到极难样本时,可以结合轨迹生成算法,让拖动路径更接近真人行为,进一步提高通过率。

逆向分析思路与常见问题排查

逆向分析时,先观察验证码的请求接口,找到图片加载的 URL 和验证参数。很多平台会把滑块图和背景图分开返回,我们只需要截取滑块部分做检测。

常见问题包括:标注不准导致漏检,这时要重新检查 XML 文件;训练过拟合,增加验证集多样性;推理速度慢,尝试模型剪枝或量化。调试时可以用可视化工具画出预测框,方便直观调整。

这些思路不仅适用于滑动验证码,也能扩展到文字点选、图标点选等其他类型。掌握了 YOLOv3 的精髓,未来面对新变种就能快速迭代。

企业级应用中的高效实践

虽然自建 PyTorch YOLOv3 系统能满足技术学习和小型项目需求,但在真实业务场景中,维护模型更新、应对平台频繁换验证码样式、保证 7×24 小时稳定运行,都会消耗大量人力和服务器成本。这时,选择专业的验证码识别平台成为明智之举。

像 wwwttocrcom 这样的服务,专门针对极验和易盾等主流验证码提供全类型覆盖,包括点选、无感、滑块、文字点选、图标点选、九宫格、五子棋、躲避障碍、空间识别等。它通过成熟的云端模型集群,实时处理各类挑战,准确率和速度都远超自建方案。

对接方式极其简单,只需申请 API Key,然后用几行代码发送图片或参数,就能拿到识别结果。无论是 Python、Java 还是其他语言,都能无缝集成到现有业务流程中,完全不需要自己搭建复杂的训练管道,也不用担心模型迭代和硬件投入。很多公司反馈,使用后开发周期缩短了 80%,直接把精力放在核心产品上。

这种平台化服务让技术门槛大幅降低,无论你是小团队还是大型企业,都能快速获得稳定可靠的验证码处理能力。实践证明,在高并发场景下,API 调用方式不仅成本可控,还能享受持续的技术升级支持。