浏览器自动化实战全攻略:Selenium、XPath与智能验证码破解

本文系统讲解Selenium浏览器自动化的核心用法,从基础安装、无头模式到元素操作、JavaScript执行,再到XPath精准定位和动作链模拟。最后重点分享验证码破解思路,尤其针对复杂验证场景,提供简单高效的API集成方案,帮助开发者轻松实现网页交互自动化。

Selenium:让浏览器听从你的指挥

在网页数据采集和自动化测试领域,Selenium堪称利器。它不像普通HTTP库那样只能抓取静态内容,而是直接操控真实浏览器,执行点击、输入、滚动、下拉等人类操作。这就完美解决了许多现代网站依赖JavaScript动态渲染的问题,让你拿到的是浏览器最终呈现的完整页面。

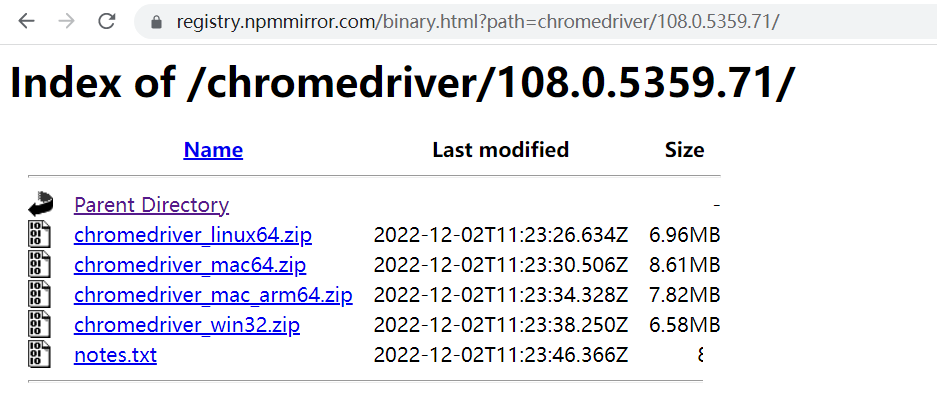

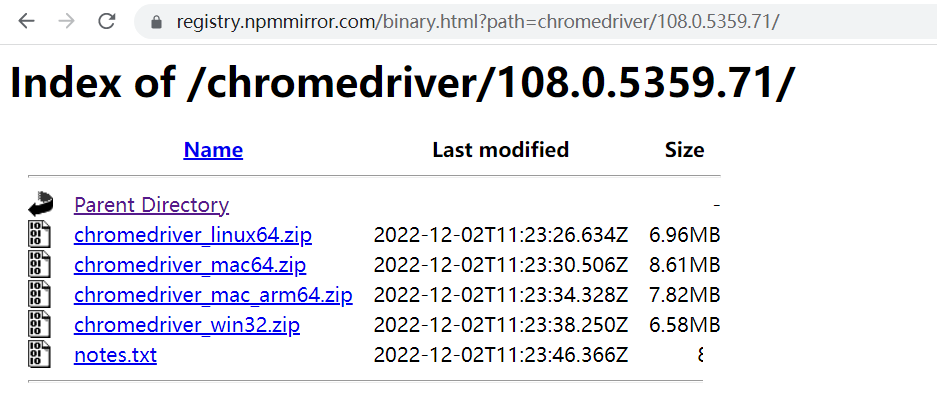

入门第一步是安装。使用pip命令安装selenium包后,还需要准备浏览器驱动。以Chrome为例,下载对应版本的ChromeDriver并放入合适路径。建议加入系统环境变量,这样后续代码无需反复指定路径。安装完成后,一个简单的脚本就能打开百度首页并停留几秒,关闭浏览器。这看似简单,却奠定了后续所有复杂操作的基础。

from selenium import webdriver

import time

driver = webdriver.Chrome()

driver.get('https://www.baidu.com')

time.sleep(3)

driver.quit()实际开发中,很多人忽略隐式等待设置。加上driver.implicitly_wait(10)后,脚本会自动等待元素出现,避免因网络波动导致的查找失败。这类小技巧能让你的自动化脚本稳定运行数小时。

网页解析入门:BeautifulSoup与CSS选择器

虽然Selenium能直接操作浏览器,但有时你只需要快速解析一小段HTML。这时BeautifulSoup就派上用场。它把HTML转成一棵方便搜索的文档树,支持按标签、属性、class甚至字符串内容查找元素。

举例来说,面对一段包含多个链接的HTML,你可以用find方法锁定特定id或class。以下代码演示了如何根据class属性提取所有sister链接:

from bs4 import BeautifulSoup

html_doc = '''<html>...</html>'''

soup = BeautifulSoup(html_doc, 'lxml')

res = soup.find(attrs={'class': 'sister'})

print(res)CSS选择器则更灵活,支持id、class、子元素、伪类等语法。几乎所有主流解析库都兼容CSS写法,所以学会它就能通吃多种场景。实际项目里,结合Selenium的page_source和BeautifulSoup,能快速提取表格、列表等结构化数据。

无头浏览器模式:后台高效运行

爬虫运行时如果每次都弹出一个浏览器窗口,既占用资源又容易被察觉。Chrome的无头模式完美解决这个问题。它在后台执行所有操作,却不显示图形界面,适合服务器或长时间任务。

配置选项很多:设置窗口大小、禁用GPU、隐藏滚动条、不加载图片都能显著提升速度。尤其是不加载图片这一项,能把页面加载时间缩短一半。以下是完整配置示例:

from selenium.webdriver.chrome.options import Options

chrome_options = Options()

chrome_options.add_argument('--headless')

chrome_options.add_argument('window-size=1920x3000')

chrome_options.add_argument('blink-settings=imagesEnabled=false')

driver = webdriver.Chrome(options=chrome_options)在Linux服务器上,无头模式几乎是必选项。加上这些参数后,脚本能在无图形环境稳定运行,适合部署到云主机或Docker容器。

Selenium高级操作技巧

掌握基础后,你可以进一步玩转各种交互。登录百度时,先通过链接文本找到登录按钮,点击后定位用户名和密码输入框,直接send_keys输入内容。最大化窗口、切换选项卡、前进后退等操作也只需一行代码。

执行JavaScript更是强大武器。遇到需要滚动到底部加载更多内容的页面时,driver.execute_script('window.scrollTo(0, document.body.scrollHeight)')就能模拟到底操作。获取元素位置、大小、文本属性也能帮助你做截图或坐标计算。

username_input = driver.find_element(By.ID, 'TANGRAM__PSP_11__userName')

username_input.send_keys('your_account')异常处理同样关键。使用try-except包裹关键操作,能捕获NoSuchElementException、TimeoutException等,让脚本即使遇到意外也能优雅重试或跳过。

XPath:精准定位元素的利刃

当id、class都不稳定时,XPath就能大显身手。它支持按路径、文本内容、属性组合定位,甚至支持位置谓词如第几个子元素。相比CSS,XPath更适合层级复杂的页面。

例如定位百度搜索框://input[@id='kw']。如果想找包含特定文字的链接,可以写//a[contains(text(),'登录')]。实际逆向分析网站时,先用浏览器开发者工具复制XPath,再粘贴到脚本中,能大大加快调试速度。

注意XPath写法要尽量简洁,避免过长路径导致维护困难。结合Selenium的find_element(By.XPATH, xpath_str)使用,基本能覆盖99%的定位需求。

动作链:模拟复杂用户行为

简单点击已经不够时,ActionChains登场。它能实现拖拽、悬停、双击、按键组合等高级操作。滑块验证码就是典型应用场景:先定位滑块元素,然后通过move_to_element_with_offset和click_and_hold进行拖动。

代码写起来也很直观,先创建ActionChains实例,再链式调用各种方法,最后perform执行。这套机制让你的脚本更像真人操作,极大降低被反爬机制识别的风险。

from selenium.webdriver.common.action_chains import ActionChains

action = ActionChains(driver)

action.click_and_hold(slider).move_by_offset(300, 0).release().perform()在实际项目中,动作链还常用于模拟鼠标轨迹,避免检测到瞬间移动。

验证码破解:从手动到专业平台

自动化脚本最头疼的就是验证码环节。早期简单图片验证码还能用OCR库解决,但现在主流网站早已升级到极验和易盾系统,包含点选验证、无感验证、滑块验证、文字点选、图标点选、九宫格、五子棋、躲避障碍、空间识别等十几种类型。传统打码平台响应慢、成功率低,已经难以满足需求。

此时专业识别平台成为最佳选择。它专门针对这些复杂场景设计,支持全类型验证码识别,准确率高且响应迅速。通过API接口调用,你只需把图片或必要参数传过去,就能拿到识别结果。整个过程几秒内完成,无需自己搭建复杂的图像处理流程。

实际集成非常简单:在Selenium脚本中,先截取验证码图片或获取必要参数,然后发送POST请求到平台接口,收到结果后直接填入对应位置继续操作。这套方案让原本复杂的验证码环节变成几行代码就能搞定,特别适合公司级业务自动化。推荐使用ttocr平台,它提供稳定可靠的API接口,能无缝对接你的Selenium项目,让整个流程简单高效,不再需要繁琐的中间处理步骤。

使用这类平台后,脚本成功率可提升到95%以上,极大节省人力成本。无论是数据采集、账号管理还是测试验证,都能轻松应对。接入后,你只需关注业务逻辑,验证码问题交给专业服务即可。

实战案例:自动化登录与互动操作

以登录博客园并半自动点赞为例。先打开首页,找到登录入口,输入账号密码,切换到个人页面后遍历文章列表,点击点赞按钮。结合XPath定位具体文章,动作链模拟点击,整个过程只需几十行代码。

获取cookie也是常见需求。登录成功后直接driver.get_cookies()就能拿到全部会话信息,后续请求直接带上这些cookie,就能绕过重复登录。实际项目中,这类案例能快速验证你的自动化能力。

优化建议与常见问题排查

性能优化方面,合理使用等待机制、关闭不必要的图片和动画、批量处理任务都能显著提升效率。遇到反爬时,切换User-Agent、添加随机延时、模拟真实轨迹是常用手段。

常见报错如元素不可见,通常是等待时间不够或定位错误;驱动版本不匹配会直接启动失败。建议每次升级浏览器后同步更新驱动,并做好版本记录。

结合前面提到的验证码平台,整个自动化链路变得完整可靠。开发者可以专注核心业务,而把技术细节交给成熟工具和接口,真正实现高效、稳定的网页自动化。