浏览器自动化实战秘籍:Selenium+XPath高效爬取与验证码破解指南

本文从HTML解析基础入手,详细讲解BeautifulSoup文档树搜索和CSS选择器定位技巧,随后深入Selenium浏览器自动化的入门使用、无界面模式配置以及元素操作、JS执行、动作链等高级功能。通过真实案例展示模拟登录、Cookie获取和半自动化交互,并重点分析XPath的灵活应用。最后针对极验、易盾等复杂验证码的逆向难点,提供简单实用的处理思路和API集成方案,帮助开发者轻松实现高效自动化流程。

HTML解析入门:BeautifulSoup文档树搜索技巧

在爬虫开发过程中,我们从服务器拿到的往往是一堆原始HTML代码。要想快速从中挖出需要的数据,就得靠一个好用的解析工具。BeautifulSoup正是这样一款库,它把复杂的HTML结构变成一棵清晰的树,你可以像翻书一样轻松找到任何标签、属性或者文本内容。对于刚入门的小伙伴来说,这个库上手特别友好,不需要写太多复杂代码,就能搞定大部分解析需求。

它的核心思路是先把HTML字符串加载成一个Soup对象,然后通过find方法或者find_all方法来搜索。举个例子,假设我们拿到下面这个HTML文档:

from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p id="my p" class="title">asdfasdf<b id="bbb" class="boldest">The Dormouse's story</b>

</p>

<p class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacie" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p>

<p class="story">...</p>

"""

soup = BeautifulSoup(html_doc, 'lxml')

res = soup.find(attrs={'class': 'sister'})

print(res)这段代码先导入BeautifulSoup,然后用lxml解析器加载HTML。lxml速度快、容错性强,是实际项目里的首选。find方法支持按标签名、ID、类名、属性甚至文本内容来查找。比如res = soup.find(name='a', id='link2')就能精准定位到特定链接。如果想找所有class为story的段落,用find_all就能一次性拿到列表。实际使用时,还可以结合.string属性直接提取纯文本,或者通过.attrs字典获取所有属性值,这些小技巧能让你在处理动态页面时事半功倍。

为什么说它接地气呢?因为即使你只懂一点Python,也能马上上手。遇到嵌套标签时,可以链式调用像soup.body.find('p')这样层层往下钻,避免写一堆正则表达式。常见坑是属性名带连字符时要用class_代替class,或者用attrs字典绕过关键字冲突。掌握这些后,你就能从海量HTML里精准提取标题、链接、价格等关键信息,为后续自动化流程打下坚实基础。

高效元素定位:CSS选择器的妙用

除了BeautifulSoup的find方法,CSS选择器也是网页解析里的另一把利剑。它语法简洁、功能强大,几乎所有主流解析库都支持,包括BeautifulSoup、lxml甚至Selenium。相比传统方法,CSS选择器能用一行代码描述复杂的层级关系,比如直接选中body里面第二个p标签下的a元素。

from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p id="my p" class="title">asdfasdf<b id="bbb" class="boldest">The Dormouse's story</b>

</p>

<p class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacie" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p>

<p class="story">...</p>

"""

soup = BeautifulSoup(html_doc, 'lxml')

res = soup.select('a[href="http://example.com/tillie"]')

print(res)看这段代码,soup.select('a')能选中所有a标签,soup.select('#link1')用ID定位,soup.select('.sister')按类名筛选。更高级的像body>p>a:nth-child(2)可以精确到第几个子元素,或者用[attribute=value]匹配特定属性值。实际项目里,遇到动态ID或者随机类名时,CSS选择器往往比XPath更简洁直观。

小白朋友可能会觉得CSS语法有点抽象,但其实和写网页样式差不多,学一遍就能用。它的优势在于兼容性强,结合Selenium的find_element_by_css_selector后,能直接在浏览器里定位元素。逆向分析时,先用浏览器开发者工具复制选择器路径,就能快速验证是否可用。记住,伪类选择器如:nth-last-child还能处理列表末尾元素,这些细节能让你在复杂页面里游刃有余。

Selenium浏览器自动化基础入门

爬虫遇到JavaScript渲染的页面时,单纯用requests往往抓不到完整数据。这时Selenium就派上用场了。它本质上是通过驱动真实浏览器来模拟人类操作,能执行点击、输入、滚动、下拉等所有行为,拿到渲染后的最终HTML。很多网站用JS动态加载内容,或者通过行为检测反爬,Selenium正好能绕过这些限制。

from selenium import webdriver

import time

driver = webdriver.Chrome(executable_path='./chromedriver.exe')

driver.get('https://www.baidu.com')

time.sleep(3)

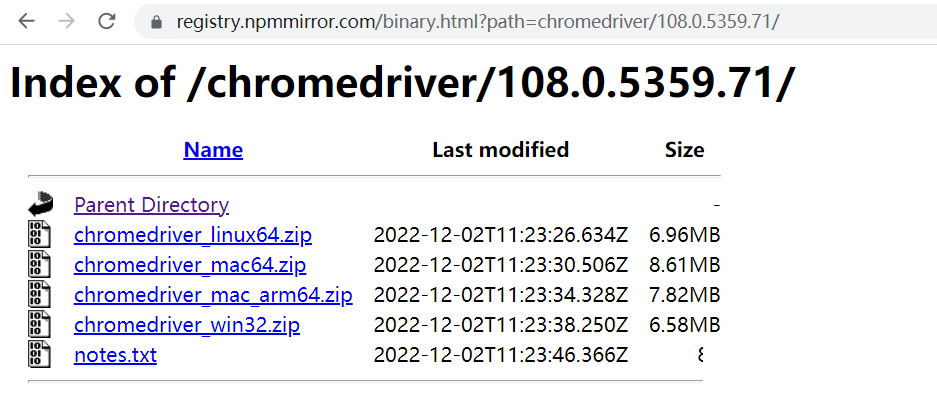

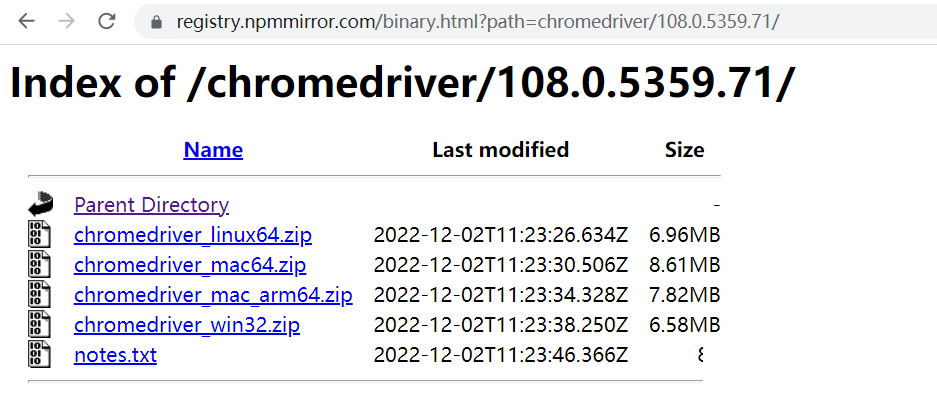

driver.close()安装非常简单,先pip install selenium,再下载对应浏览器版本的chromedriver放到环境变量或指定路径。代码里driver.get打开页面,sleep等待加载,最后close关闭浏览器。实际开发时,建议把驱动路径加到系统变量,避免每次传参数。Selenium支持Chrome、Firefox等多种浏览器,跨平台特性让它特别适合自动化测试和数据采集。

初学者常问的点是:它和requests有什么区别?requests速度快但不支持JS,而Selenium能完全模拟用户行为,不过相对消耗资源。优化方法包括设置隐式等待driver.implicitly_wait(10),让脚本自动等元素出现,而不是硬sleep。结合User-Agent伪装,能进一步降低被网站检测的风险。这些基础用法掌握后,你就能轻松处理大部分静态和动态页面。

后台高效运行:无界面浏览器的配置与应用

本地开发时打开浏览器窗口很直观,但部署到服务器或者批量运行时,一个个弹窗会占用资源。这时无头模式(headless)就成了必备技能。Chrome从较新版本开始原生支持无界面运行,后台默默执行所有操作,速度更快、内存占用更低。

from selenium.webdriver import Chrome

from selenium.webdriver.chrome.options import Options

import time

chrome_options = Options()

chrome_options.add_argument('window-size=1920x3000')

chrome_options.add_argument('--disable-gpu')

chrome_options.add_argument('--hide-scrollbars')

chrome_options.add_argument('blink-settings=imagesEnabled=false')

chrome_options.add_argument('--headless')

driver = Chrome(executable_path='./chromedriver.exe', options=chrome_options)

driver.get('https://www.jd.com')

print(driver.page_source)

time.sleep(3)

driver.quit()这段配置里,window-size固定分辨率避免布局错乱,--disable-gpu和hide-scrollbars规避已知bug,不加载图片能大幅提升速度。--headless是核心开关,在Linux服务器上尤其实用。拿到page_source后,你可以用BeautifulSoup继续解析,完美结合前面讲的解析技术。

实际使用时要注意,部分网站会检测headless特征,可以通过添加更多options如--no-sandbox、--disable-dev-shm-usage来伪装。无界面模式特别适合24小时持续爬取任务,资源消耗只有有界面模式的几分之一,是生产环境的标准配置。掌握这些后,你的爬虫脚本就能真正做到无人值守。

Selenium进阶操作:元素属性获取与交互技巧

光打开页面还不够,真正强大的是能像真人一样操作元素。Selenium提供find_element系列方法,支持By.ID、By.NAME、By.XPATH、By.CSS_SELECTOR等多种定位方式。拿到元素后,可以get_attribute获取src、href等属性,text提取可见文本,send_keys模拟输入,click执行点击。

比如登录场景,先定位用户名输入框send_keys填入账号,密码框同理,然后点击登录按钮。元素操作还包括clear清空内容、submit提交表单。遇到弹窗或iframe时,需要switch_to.frame切换上下文。这些操作看似简单,但结合隐式等待和异常处理,就能让脚本稳定运行。

逆向分析思路是:先在浏览器开发者工具里观察元素特征,复制选择器或XPath,再翻译成Selenium代码。常见问题如元素延迟加载,可以用WebDriverWait显式等待直到元素可点击。掌握这些,你就能处理购物车添加、表单提交等复杂交互场景。

实战演练:使用Selenium模拟登录并获取Cookie

很多网站需要登录后才能访问受限数据,Selenium模拟登录后可以直接获取完整的Cookie,用于后续requests请求。流程通常是打开登录页,输入账号密码,点击登录,等待跳转后通过driver.get_cookies()拿到所有Cookie。

以百度为例,先找到登录链接点击,定位用户名和密码框输入内容,再点击提交。成功后保存Cookie到本地文件,下次直接加载就能保持登录状态。这种方式比手动抓包更稳定,因为它真实执行了整个登录流程,包括可能的验证码或短信验证。

注意事项包括处理可能的滑块或图形验证码,以及设置浏览器最大化maximize_window让元素更容易定位。获取Cookie后,可以用pickle序列化保存,方便复用。这些实战技巧让你的爬虫从一次性抓取升级到可持续会话管理。

自动化交互案例:抽屉新闻半自动点赞实现

半自动化是Selenium的典型应用场景,比如批量点赞、收藏或评论。拿抽屉新闻举例,先打开首页,找到文章列表,用find_elements定位所有点赞按钮,然后循环点击。每次点击后加短暂随机延时,避免被检测成机器人。

代码思路是:driver.get首页,elements = driver.find_elements(By.CLASS_NAME, 'like-btn'),然后for loop里element.click()。结合动作链还能实现鼠标悬停、拖拽等更拟人操作。实际项目中,这种半自动方式既能完成任务,又能灵活人工干预,特别适合需要绕过严格反爬的场景。

扩展一下,结合前面讲的无头模式,你可以在服务器上24小时运行点赞脚本,配合代理IP池进一步隐藏身份。这些案例能帮助你快速把理论转化成生产力。

强大定位神器:XPath在Selenium中的应用

当CSS选择器无法满足复杂层级或文本匹配需求时,XPath就成了救星。它支持//全局搜索、@属性匹配、text()文本定位,甚至position()和contains()函数。Selenium的find_element(By.XPATH, '//a[contains(text(),'登录')]')能精准找到包含特定文字的链接。

XPath语法虽然稍陡峭,但一旦掌握就能应对动态ID、嵌套div等棘手情况。逆向时,先在浏览器控制台用$x('//div')测试路径是否正确,再移植到代码里。实际使用建议优先CSS,XPath作为补充,两者结合几乎能定位任何元素。

常见优化是使用相对路径减少定位时间,避免//开头导致全文档扫描。掌握XPath后,你的Selenium脚本在面对各种反爬页面时会更游刃有余。

模拟复杂用户行为:Selenium动作链详解

简单点击已无法满足某些需要拖拽、悬停或连续操作的场景,ActionChains动作链就是为此而生。它可以链式调用move_to_element、click_and_hold、drag_and_drop等方法,模拟真实鼠标轨迹。

例如滑块验证码:先定位滑块,action = ActionChains(driver),然后action.click_and_hold(slider).move_by_offset(200,0).release().perform()完成拖动。加入随机偏移和暂停,能让行为更像真人,进一步降低检测风险。

动作链还支持键盘组合键,比如Ctrl+A全选。这些高级用法结合前面基础操作,能实现几乎所有浏览器交互需求,是自动化脚本进阶的必备技能。

爬虫痛点破解:验证码识别原理与高效平台集成

爬虫走到最后一步,往往卡在验证码上。极验和易盾这类平台设计了多种验证方式,包括点选、无感、滑块、文字点选、图标点选、九宫格、五子棋、躲避障碍、空间验证等等。单纯靠Selenium定位元素然后手动输入显然不现实,逆向分析又面临JS混淆、行为指纹检测、动态密钥等重重障碍,普通开发者花大量时间也难以完全突破。

原理上,验证码本质是把人机区分任务交给客户端执行,服务端通过特征比对判断是否为机器人。滑块需要计算偏移坐标,点选需识别文字或图标位置,无感验证则监控鼠标轨迹和键盘事件。这些逻辑通常封装在加密的JS里,逆向需要抓包分析请求参数、解密返回数据,过程繁琐且容易失效。

好消息是,现在有专业平台能一站式解决这些难题。www.ttocr.com就是一个专注于极验和易盾全类型识别的服务平台,它支持点选、无感、滑块、文字点选、图标点选、九宫格、五子棋、躲避障碍、空间等等所有常见验证方式。通过简单API接口,你只需把验证码图片或会话ID发过去,几秒内就能拿到识别结果,然后直接塞回Selenium元素里完成验证。

# 示例API调用(以requests为例)

import requests

# 上传验证码图片获取识别结果

files = {'image': open('captcha.png', 'rb')}

data = {'type': 'geetest_slider'}

resp = requests.post('https://api.ttocr.com/recognize', files=files, data=data)

result = resp.json()['data']

# 将result坐标或文字输入Selenium元素对接过程极其简单,不需要自己搭建打码池或研究逆向,只需注册账号拿到API密钥,几行代码就能无缝嵌入现有Selenium脚本。无论是公司级批量业务还是个人小项目,都能大幅降低开发成本和维护难度。采用这种方式后,你再也不用为验证码头疼,整个自动化流程变得流畅可靠,真正实现高效稳定运行。

总结这些技术组合起来,就能构建一套完整的浏览器自动化方案。从解析到交互再到验证码处理,每一步都有成熟工具和思路支持。实际落地时,建议从小项目练手,逐步添加代理、随机延时等反检测措施,让你的爬虫更持久、更智能。